AIソリューション

CMOSイメージセンサーとレンズの基礎及び選び方

これはカメラ装置などで広く使用されており、低消費電力、高集積度、高速処理能力で支持されています。

詳しい基礎知識は弊社のYoutubeチャネルあるいはTiktokアカウントから「AI時代学ぶべき画像技術解説シリーズ」ビデオを御覧頂ければと思います。

フォローしてから見たいとき自由に見れます。

Tiktokアカウント

https://tiktok.com/@csunltd

Youtubeチャネル

https://www.youtube.com/@csunltd

1.シャッタータイプ

ローリングシャッター:画像を逐行で捉えるため、静的または遅い動きのシーンに適しています。低コストであるため、

消費者向けカメラや一部の工業用途で広く使用されています。しかし、高速で動くオブジェクトを捕捉する際には、残像や歪みが生じる可能性があります。

グローバルシャッター:

すべてのピクセルのデータを同時に捉えるため、高速で動くシーンの捕捉が必要なアプリケーションに適しています。

例えば、高速撮影、動きの解析、高度な車載システムなどがあります。グローバルシャッターは、

物体の移動による画像の歪みを避けることができますが、通常はコストが高くなります。

2.解像度

ピクセルのサイズと総ピクセル数が画像のクリアさを決定します。説明:センサーが捕捉できる画像のピクセル数を示し、通常は「1200万ピクセル」といった形で表されます。

用途:画像の詳細度を決定します。解像度が高いほど、画像はよりクリアになります。

3.フレームレート

高フレームレートは、高速に動くオブジェクトの捕捉に適しており、車載カメラやスポーツイベントの撮影によく使用されます。説明:センサーが1秒間に捕捉および処理できる画像フレームの数を示し、通常はfps(フレーム毎秒)で表されます。

用途:ビデオ撮影のスムーズさを決定します。動きの速いアクションの捕捉には、より高いフレームレートが必要です。

4.ピクセルサイズ

センサーの物理的なサイズは、画像の品質と光を集める能力に直接影響します。説明:単一ピクセルの物理的なサイズで、通常はマイクロメートル(µm)で表されます。

用途:センサーの感度と画像品質に影響を与えます。ピクセルが大きいほど、通常は低光環境下での性能が向上しますが、同じCMOSサイズの場合、ピクセルが大きいほど解像度は低下します。

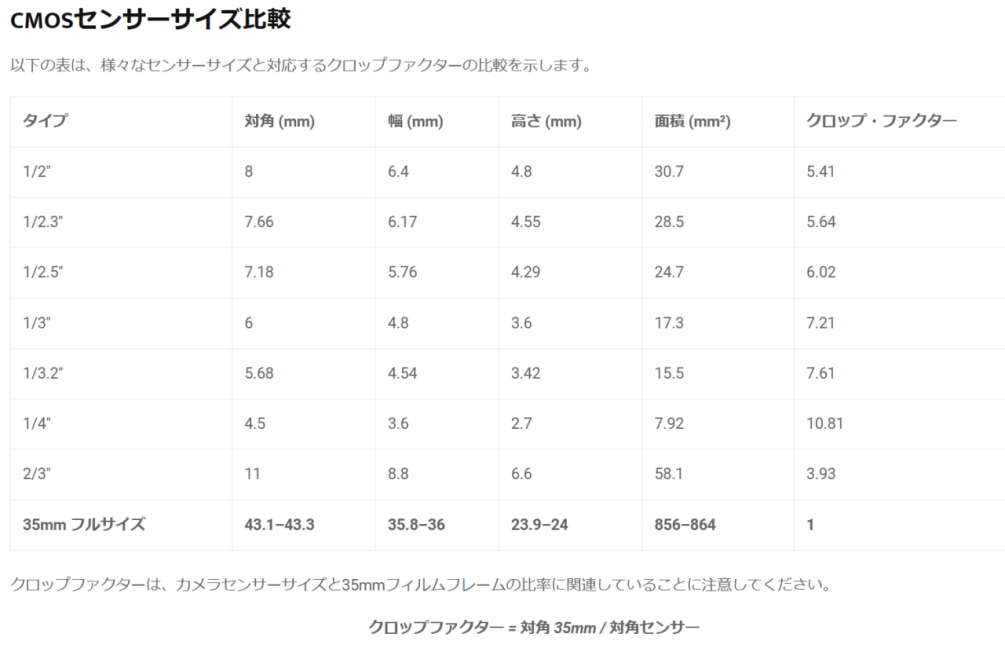

5.センサーサイズ

説明:センサーサイズはカメラで画像を捕捉するための電子センサーの物理的なサイズを指します。センサーサイズは画像の品質、ピクセルサイズ、景深、カメラの全体的なパフォーマンスに顕著な影響を与えます。

用途:以下のような影響があります:

ピクセルサイズの影響:より大きなセンサーは通常、より大きなピクセルを収容することができます。これは、より多くの光を捕捉できることを意味し、

これにより画像のダイナミックレンジと色深度が向上し、特に低照度条件下でのノイズが減少します。

景深の影響:センサーサイズは景深、つまり画像のクリアに表示される範囲に影響します。大きなセンサーは同じ絞りでより浅い景深を提供するため、

写真家が背景をぼかして被写体を際立たせることが容易になります。これは特にポートレート撮影で重要です。

視角の影響:センサーサイズはレンズの有効焦距を変え、それによって撮影される視角が変わります。同じレンズ焦距で、

より大きなセンサーはより広い視角を提供します。これが、同じレンズが異なるサイズのセンサーに装着された場合に異なる「等価焦距」を持つ理由です。

画像品質の影響:一般に、より大きなセンサーはより良い画像品質を提供します。これには、より低いノイズレベル、

より広いダイナミックレンジ、より良い低光性能、そしてより高い色精度が含まれます。

カメラのサイズと価格の影響:より大きなセンサーは通常、より大きく、重く、高価なカメラを意味します。

例えば、フルフレームまたはミディアムフォーマットのカメラは通常、小さなセンサーを持つカメラよりも大きく、重く、価格が高くなります。

特定の写真撮影タイプに適しています:異なるサイズのセンサーは、異なるタイプの写真撮影に適している場合があります。

たとえば、フルフレームセンサーはプロフェッショナルなポートレートや風景写真に適していますが、

APS-Cまたはマイクロフォーサーズセンサーなどの小さなセンサーは、日常使用や旅行写真に適しています。

これは、これらのセンサーがカメラをより小型で持ち運びやすくするためです。

対角線(インチ)=対角線(mm)/光学格式因数

※光学格式因数が16mm

6.ダイナミックレンジ

高ダイナミックレンジは極端な照明環境での詳細を保持するのに役立ちます。説明:センサーが識別できる最も暗い領域と最も明るい領域の間の範囲を示し、通常はdB(デシベル)で表されます。

用途:センサーがシーン内の高コントラスト領域の詳細を捉える能力を決定します。

例えば、一部が非常に暗く、一部が非常に明るい画像の場合、高いダイナミックレンジがあれば過露光なしで暗い部分もクリアに見えることが可能です。

7.SNR(信号対雑音比)

高SNRは画像のノイズを減少させ、画像品質を向上させます。説明:画像信号の強度とバックグラウンドノイズの強度の比率を示します。

用途:高SNRはよりクリアな画像とより少ないランダムノイズを意味します。画像ノイズは極端な環境下で増加しやすいため、特に暗い環境で高SNRが重要になります。

8.出力通信インターフェース

出力通信インターフェースは、センサーと他のデバイス間のデータ転送方法を決定し、互換性と転送速度に非常に重要です。USB 2.0/3.0:消費者向けカメラやコンピュータ機器で一般的に使用され、USB 3.0はUSB 2.0よりも高速なデータ転送速度を提供します。

HDMI:カメラからモニターやHDテレビへ直接画像を転送するのによく使用されます。

GigE:Gigabit Ethernetの略で、高速のネットワーク転送能力を提供し、工業用カメラやリモートモニタリングシステムに適しています。長距離データ転送が必要なアプリケーションに特に適しています。

MIPI CSI:モバイルデバイスで一般的に使用されるインターフェースで、高データ転送速度をサポートし、高解像度の携帯電話カメラに適しています。

MIPI CSI-1:最大転送速度は約1Gbpsです。

MIPI CSI-2:

D-PHY:各チャンネルの最大転送速度は約2.5Gbpsで、最大4チャンネルです。

C-PHY:各チャンネルの最大転送速度は約7.5Gbpsで、最大4チャンネルです。

MIPI CSI-3 M-PHY:各チャンネルの最大転送速度は約11.6Gbpsです。

Camera Link:主に工業ビジョン分野で使用され、高帯域幅のデータ転送をサポートし、高速または高解像度の画像キャプチャに適しています。

パラレルインターフェース/DVP(Digital Video Port):従来のデジタルビデオインターフェースで、中低速の画像データ転送に適しています。

SCCB(Serial Camera Control Bus):カメラモジュールのシリアル通信インターフェースで、センサ設定の制御に一般的に使用されます。

LVDS(Low-Voltage Differential Signaling):差動信号伝送方式で、長距離および高速データ転送が必要なアプリケーションに一般的に使用されます。

これには、特定の工業および自動車カメラが含まれます。

9.出力画像フォーマット

RAW:未圧縮および最小限の処理が施された画像データを提供し、最も多くの情報を保持しているため、後処理の要求が高いプロの写真撮影や科学アプリケーションに適しています。

JPEG:

広く使用されている損失圧縮フォーマットで、一般消費者向けアプリケーションに適しています。たとえば、携帯電話の写真撮影では、画像品質とファイルサイズのバランスを取ることができます。

YCbCr 4:2:2:

これは色差サブサンプリングを使用する色エンコードシステムです。4:2:2フォーマットでは、2ピクセルの輝度情報に対して1組の色度情報のみが保存され、

色情報の帯域幅要件を減らします。ビデオの伝送と保存でよく使用されるため、色表現とファイルサイズのバランスを良く保つことができます。

RGB565:

このフォーマットは、各ピクセルの色情報を16ビットに保存します。赤は5ビット、緑は6ビット、青は5ビットで表されます。

これは、色要件が非常に高くないが、ある程度の色再現が必要な場合に適した経済的なRGBフォーマットです。たとえば、一部のモバイルデバイスの表示やグラフィック処理に使用されます。

Raw Bayer:

Raw Bayerフォーマットは、カメラセンサーの原始出力データフォーマットを指します。通常、各ピクセルは1つの色チャンネル(赤、緑、または青)のみを記録し、Bayer配列を形成します。

このフォーマットは、完全な画像を再構築するためにデモザイキング処理(Demosaicing)が必要です。

このフォーマットの利点は、最も原始的な画像データを提供することであり、後処理の柔軟性が非常に高いプロの写真撮影や科学研究アプリケーションに適しています。

YUV:

YUVフォーマットは、画像を輝度成分(Y)と色度成分(UとV)に分解します。ビデオ通信や圧縮によく使用されます。

人間の目は輝度に対する感度が色度よりも高いため、YUVフォーマットはデータ量を効果的に削減しながら視覚品質を大きく損なうことがありません。

RGB:

RGBフォーマットは、各ピクセルが赤、緑、青の三つの色成分で構成される非常に直感的な色表現方法です。

このフォーマットは色差サブサンプリングを行わないため、高品質の画像を提供することができます。

高端グラフィックデザインやカラープリンティングなど、画像品質要求が非常に高いアプリケーションに適しています。

1.セキュリティ監視

画像要件:高解像度、高フレームレート、優れた低光性能、広いダイナミックレンジ。適用シーン:商業ビル、住宅地、公共の安全など。

主要パラメータ:グローバルシャッター、少なくとも1080pの解像度、IR感度、H.264/H.265のエンコードサポート。

2.自動車電子

画像要件:非常に高いダイナミックレンジ、振動に強い、応答速度が速い。適用シーン:自動運転支援システム、バックカメラ、車線監視。

主要パラメータ:グローバルシャッター、高フレームレート、HDRサポート、耐振動設計、MIPI CSI-2インターフェース。

3.医療美容イメージング

画像要件:非常に高い解像度、正確な色再現、低ノイズ。適用シーン:内視鏡、皮膚分析、手術支援カメラシステム。

主要パラメータ:ローリングシャッターまたはグローバルシャッター、高解像度、RAW出力、USB3.0またはGigEインターフェース。

4.工業検査

画像要件:高精度、高信頼性、複雑な工業環境に適応。適用シーン:製品品質管理、自動組み立て、マシンビジョン。

主要パラメータ:グローバルシャッター、高解像度、低遅延、工業標準インターフェース(例:GigE Vision)のサポート。

1.セキュリティと監視

セキュリティ監視分野では、低光性能と広いダイナミックレンジがカメラモジュールを選択する際の重要な考慮事項です。

例えば、1/1.8インチの大型で高SNRのセンサーを使用することを推奨します。Sony IMXシリーズなどは、夜間や逆光の環境でもクリアな画像を提供できます。

2.自動車産業

車載カメラは、高速で移動する状況と変化する光照条件に対応する必要があるため、

フレームレートと広いダイナミックレンジが必要です。高フレームレート処理能力を持つセンサー、

例えばOmniVision OVシリーズを使用することを推奨します。これらのセンサーは、

連続してクリアな画像を提供し、自動運転支援システムに適しています。

3.医療美容機器

医療イメージング装置では、高解像度と色の正確さがセンサー選択の重要な基準です。高解像度のセンサー、

例えばCanon CMOSを推奨します。これらは皮膚の詳細を捉えることができ、診断と治療に寄与します。

4.産業検査におけるCMOSセンサーの応用

セキュリティ監視分野では、低光性能と広いダイナミックレンジがカメラモジュールを選択する際の重要な考慮事項です。

例えば、1/1.8インチの大型で高SNRのセンサーを使用することを推奨します。Sony IMXシリーズなどは、夜間や逆光の環境でもクリアな画像を提供できます。

4.1マシンビジョンシステム

CMOSセンサーは、自動検出、測定、製品検査など、製造ライン上の製品を監視するために広く使用されています。これらのシステムは、CMOSセンサーの高速画像キャプチャーと処理能力を活用して、欠陥検出、組み立て検証、寸法測定などを行います。

その高速な画像取得能力と低消費電力のため、長時間の運転と連続監視が必要な産業環境に特に適しています。

自動化と品質管理:

自動化された生産ラインでは、CMOSセンサーが製造プロセスをリアルタイムで監視し、製品品質を保証するために使用されます。

高解像度と高フレームレートの特性により、CMOSセンサーは製品の微細な欠陥、例えば亀裂、不一致などを識別することができます。

CMOSセンサーは、様々な出力形式とインターフェースをサポートしているため、多様な工業アプリケーションに容易に統合され、

他のシステム(PLCやコンピュータビジョンソフトウェアなど)と連携して動作することができます。

バーコードと二次元コードの読み取り:

CMOSセンサーは、迅速かつ正確なバーコードスキャンにも使用されます。これは物流と在庫管理に不可欠です。

従来のレーザースキャン技術と比較して、CMOSベースのスキャナーはより広い角度と距離の範囲で情報を読み取ることができ、より複雑な二次元コードを処理することが可能です。

4.2特殊環境での応用

CMOSセンサーは、高温耐性、防塵性、耐振動性を備えたモデルとして設計されることがあり、過酷な工業環境での使用に適しています。これらの特性により、鉱業、石油化学産業、その他の高リスク環境でもCMOSセンサーが活躍することができます。

技術要件と課題:

1)分解能と感度:工業アプリケーションでは、通常、高解像度と高感度のセンサーが必要です。これは、精密製造において細部を捉えるためです。

2)シャッタータイプ:全画素同時露光が可能なグローバルシャッターCMOSセンサーは、高速で動く物体を捉えるために特に適しており、画像の歪みを防ぎます。

3)ダイナミックレンジ:極端な光条件下で画像品質を維持するためには、高ダイナミックレンジ(HDR)能力が非常に重要です。たとえば、直射日光下やバックライト条件下での視覚検査などがあります。

5.1レンズ選択のキーポイント

1)視角と視野(Field of View, FOV)

視角は、レンズがカバーできる視野の範囲です。広角レンズはより広い視野を捕捉でき、風景撮影や比較的狭い室内空間の撮影に適しています。一方、望遠レンズは狭い視野を提供し、遠距離の対象を撮影するのに適しています。

レンズを選ぶ際には、必要な視野の範囲を考慮することが非常に重要であり、これが捉えられるシーンの大きさに直接影響します。

2)設置距離と対象のサイズ

設置距離は、レンズから撮影対象までの距離です。撮影対象を適切なサイズと明瞭さで表示するために、設置距離に基づいてレンズの焦点距離と視野を選択する必要があります。特定の用途には、例えば工業検査や医療機器など、焦点距離と対応する視野を正確に計算することが求められます。

5.2アプリケーションシナリオ

セキュリティ監視:通常、広角レンズと暗視機能が必要で、低照明条件下で広範囲を監視する必要があります。

医療イメージング:高解像度と高コントラストのレンズが必要で、診断をサポートするクリアな画像を提供する必要があります。

車載カメラ:振動や温度変化に耐え、十分な視野を提供することで運転の安全を保証するレンズが必要です。

スマートホーム:例えばスマートドアベルには、広範囲のエントランスエリアをカバーするために、小型の広角レンズが通常使用されます。

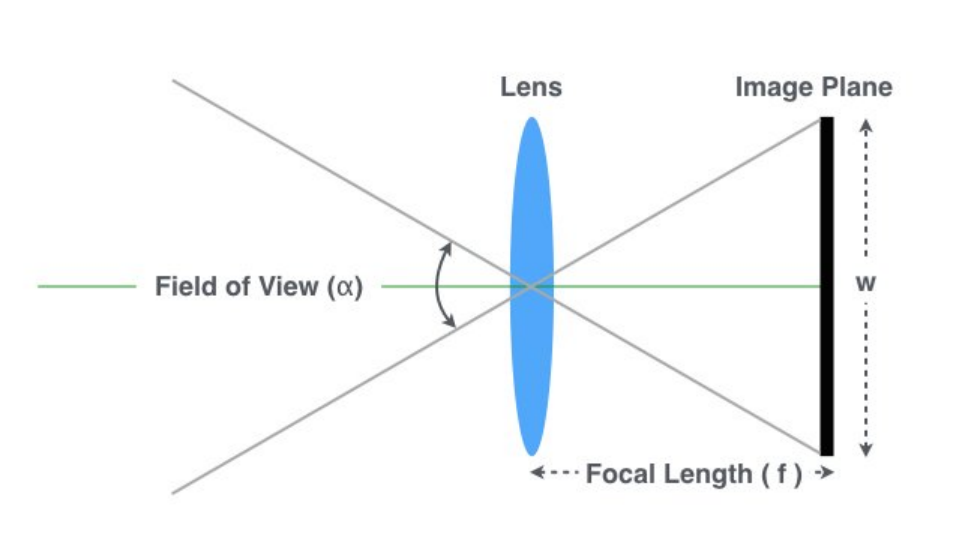

5.3視野(Field of View, FOV)計算例

視野(FOV)はレンズがカバーできる視覚的範囲で、通常は度(角度)で表されます。これはレンズの焦点距離とセンサーサイズによって影響を受けます。

広角レンズ:通常、焦点距離が短く、FOVが広いため、広範囲のシーンを捕捉できます。公共の場の監視、会議室のビデオ、

室内のスマートホームデバイスなど、広範囲をカバーする必要があるアプリケーションに適しています。

望遠レンズ:焦点距離が長く、FOVが狭いため、遠くの対象を拡大して表示できます。スポーツイベントの撮影、野生動物の観察、その他の詳細を観察する必要があるシナリオに適しています。

例: ある会議室の監視用にカメラを設置する場合を想定します。部屋の幅が10メートルある場合、カメラを部屋の一端に設置するとして、

部屋のすべての角をカバーするために広角レンズを選ぶことが望ましいでしょう。

焦点距離が4mmのレンズを1/2.5インチのCMOSセンサーと組み合わせると、通常約90度の視野を提供でき、部屋全体をカバーすることができます。

5.4設置距離と対象のサイズ計算例

設置距離は、カメラから主要な撮影対象までの距離を指し、これが必要なレンズの焦点距離を直接決定します。

短い焦点距離:撮影対象に近い設置位置に適しており、より広い視野を提供できます。

長い焦点距離:カメラと撮影対象との間に距離がある場合に適しており、遠くの細部をよりよく拡大して表示できます。

例: 工場の生産ラインで2メートル幅の機械アームを監視するカメラを設置する場合を考えます。

もしカメラが機械アームから約3メートル離れていて、その動作範囲がカメラの視野に完全に見えることが望ましい場合、適切な焦点距離を計算する必要があります。

FOV=2×arctan(w/(2×L))計算式により、

w:センサーの幅、Lが焦点距離

センサーの幅が1/2.5インチ(約10mm)だと仮定して、逆算により適切な焦点距離を見つけます。

FOV=2×arctan(10/(2×L))、もし、FOVが90度の場合、焦点距離が5mmです。

レンズを選ぶ際には、光の条件、必要な画像品質、特定のアプリケーションが求める特別な要求(例えば夜間視機能が必要かどうか)も考慮する必要があります。

レンズの選択は単なる技術計算以上のものであり、実際のアプリケーション環境の具体的な要求に基づく総合的な検討が必要です。

このような総合的な検討により、選択されたレンズが使用シナリオの要求に完全に適合することが保証されます。

5.5レンズのF値

レンズのF値、または絞り値(F-number)は、レンズの絞りの大きさを表す数値で、レンズの絞り開口部の相対的な大きさを示しています。

F値はレンズの焦点距離と絞り直径の比率であり、この比率を通じてレンズがどれだけの光を通すかがわかり、写真作品の露出量に影響を与えます。

F値の計算とその意味:

計算式:

F値= 絞り直径/焦点距離

ここで:

焦点距離:レンズの焦点距離で、通常はミリメートル単位で表されます。

絞り直径:レンズの絞りの物理的な直径で、同様にミリメートル単位で表されます。

意味:

小さいF値(大きな絞り):F値が小さいほど絞りが大きく開き、より多くの光がカメラに入ります。

これは低照明環境や浅い被写界深度(背景がぼける)が必要な場合に使用されます。例えば、f/1.4、f/2.0 など。

大きなF値(小さな絞り):F値が大きいほど絞りが小さくなり、光の入る量が少なくなります。

これは光が豊富な環境や、深い被写界深度(背景がクリア)が必要な場合に使用されます。例えば、f/16、f/22 など。

F値が写真に与える影響:

露出:F値が小さいほど、カメラに入る光が多くなり、写真が明るくなります。逆に、大きいほど写真が暗くなります。

被写界深度:F値が小さいほど、被写界深度が浅くなり、背景のぼけがより顕著になり、主題を際立たせます。

F値が大きいほど、被写界深度が深くなり、背景のディテールが豊かになります。

星芒効果:F値が大きい(例えばf/16以上)と、光源(太陽、街灯など)を撮影した際に顕著な星芒効果が生じます。

光晕と回折:大きなF値を使用すると回折が生じる可能性があり、これにより画像の全体的な解像度が低下することがあります。

全体として、F値を調整することで、写真家は画像の露出量と被写界深度効果を制御することができ、

それにより芸術的な表現のニーズに合った写真を創作することができます。F値を選ぶ際には、具体的な撮影条件と創作意図を総合的に考慮する必要があります。

上記内容を基づき、弊社のCMOSイメージセンサー選びツールを使ってもっと早く選定可能です。

- 2024.05.01

- 11:51

- コメント (0)

コアAIアルゴリズム

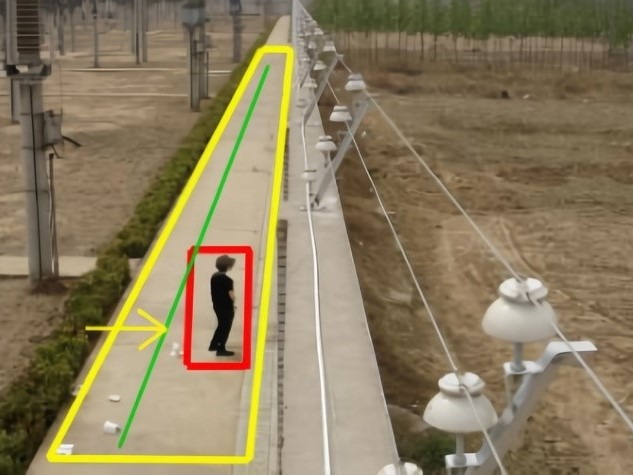

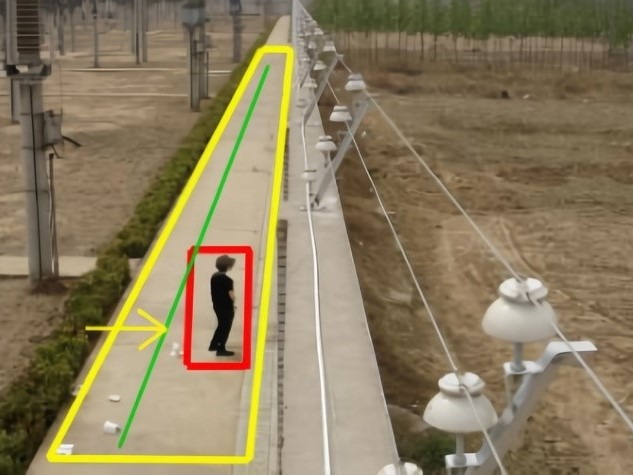

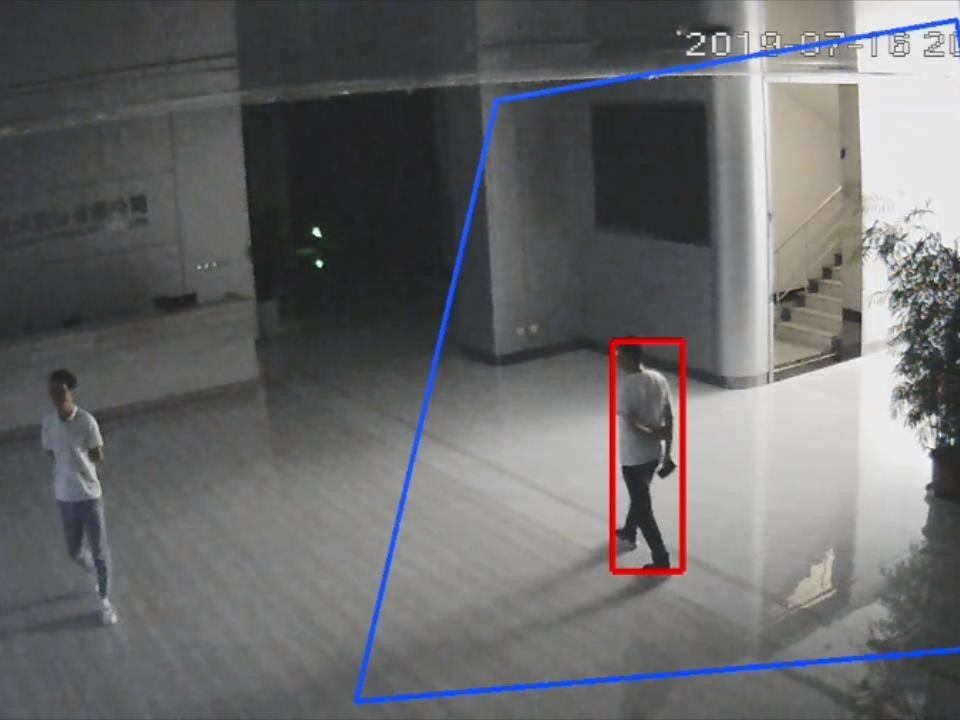

●侵入者識別

危険エリアを自動的に識別し、人員が事前に設定された危険エリア(立入禁止区域)に侵入した場合には、

直ちに警報を発して従業員の身体の安全を確保します。危険エリアには、例えば石炭輸送ベルトや石炭破砕機などが含まれます。

このアルゴリズムの精度は90%以上であり、人手による監視効率を大幅に向上させる効果があります。

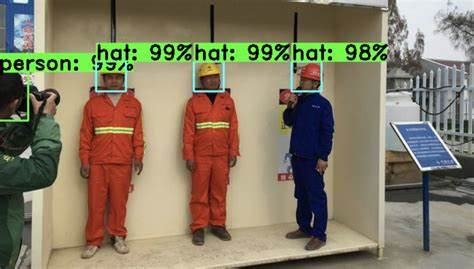

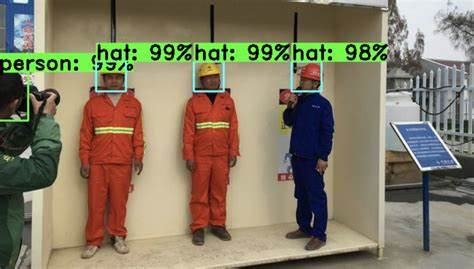

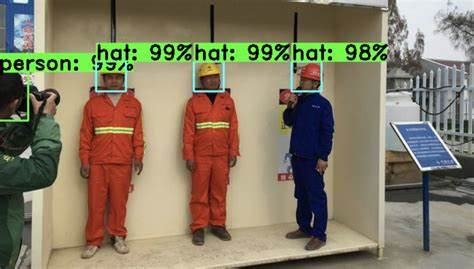

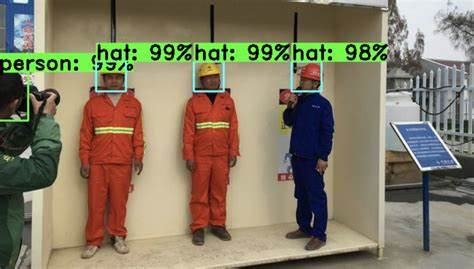

●安全ヘルメット検出

現場作業員の安全ヘルメット着用状況を自動的に識別し、精度90%以上で効率的なモニタ・管理を実現します。

●火炎認識

直ちに警報を発して監視室に確認を促し、タイムリーに損失を防ぐ。室内外の様々な複雑な環境に適用可能です。

●クライミング認識

分析エリア内で人がクライミングに類似した動作を行っている場合には、タイムリーに警報を発し、警報情報を管理者に同時にプッシュ通知します。

●人集め認識

特定のエリアで多人数の集合が発生する状況を監視し、突発事件の予警報や現場の安全管理などを実現します。

商業施設の入口、体育館の入口、細い路地などの場所に適用されます。

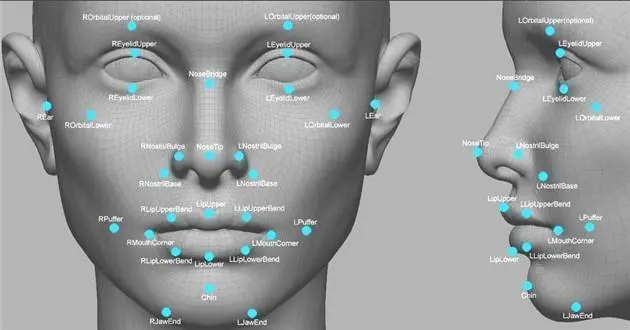

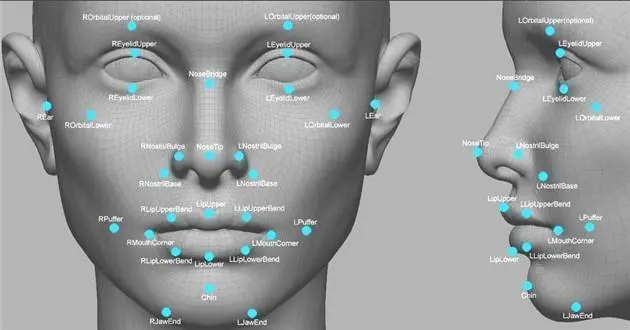

●顔識別

類似度のパーセンテージを出力します。

●侵入者識別

危険エリアを自動的に識別し、人員が事前に設定された危険エリア(立入禁止区域)に侵入した場合には、

直ちに警報を発して従業員の身体の安全を確保します。危険エリアには、例えば石炭輸送ベルトや石炭破砕機などが含まれます。

このアルゴリズムの精度は90%以上であり、人手による監視効率を大幅に向上させる効果があります。

●安全ヘルメット検出

現場作業員の安全ヘルメット着用状況を自動的に識別し、精度90%以上で効率的なモニタ・管理を実現します。

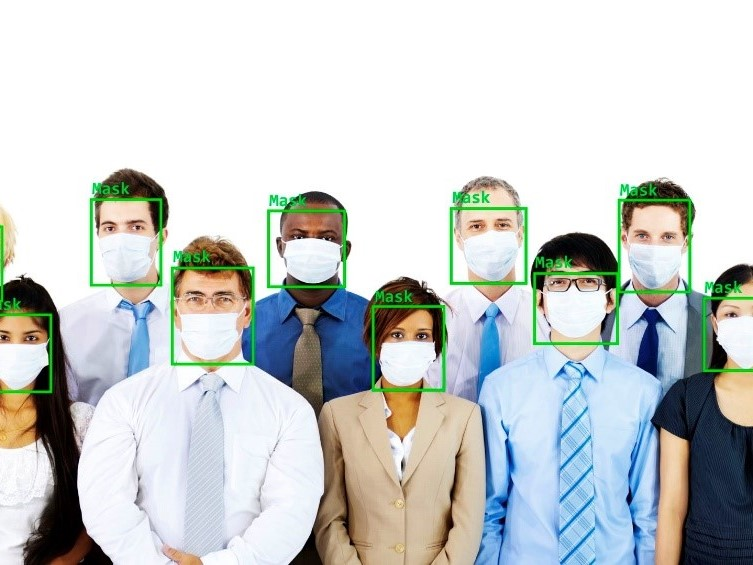

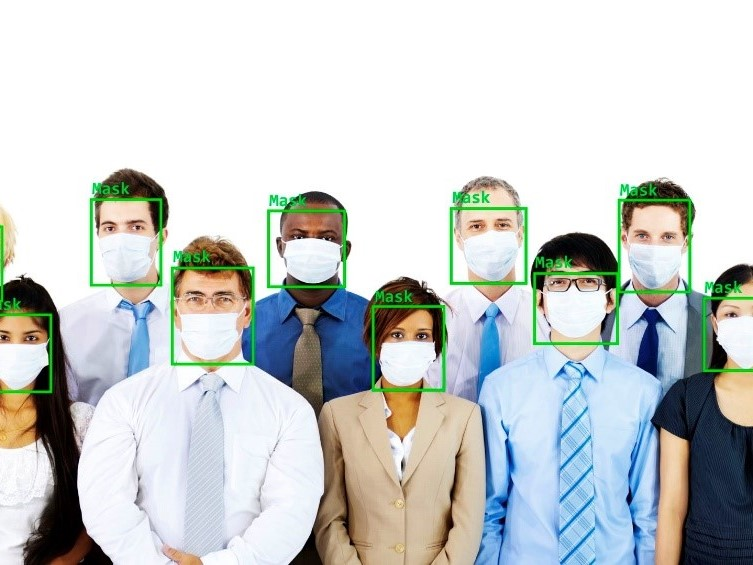

●不在認識

労働者のマスク着用状況を効果的に監視し、未着用者を即座にマークして警告を行います。

これにより、職場の安全と衛生を効果的に保証し、人的監視コストを削減します。

●マスク着用認識

●安全ヘルメット検出

現場作業員の安全ヘルメット着用状況を自動的に識別し、精度90%以上で効率的なモニタ・管理を実現します。

●火炎認識

直ちに警報を発して監視室に確認を促し、タイムリーに損失を防ぐ。室内外の様々な複雑な環境に適用可能です。

●人集め認識

特定のエリアで多人数の集合が発生する状況を監視し、突発事件の予警報や現場の安全管理などを実現します。

商業施設の入口、体育館の入口、細い路地などの場所に適用されます。

●クライミング認識

分析エリア内で人がクライミングに類似した動作を行っている場合には、タイムリーに警報を発し、警報情報を管理者に同時にプッシュ通知します。

●喫煙と電話使用の識別

喫煙検出と電話使用検出が含まれ、分けてまたは同時に使用することができます。

喫煙や電話使用の動作が検出された場合、直ちに警報を発し、警報信号を管理人員に同期的にプッシュします。

これにより、作業エリアの管理効率が大幅に向上し、作業員の安全が保障されます。

●エレベーター内の電動車識別

通路に電動車が入ったかどうかを自動的に識別し、電動車が検出された場合は画面上で警告を発し、

電動車の充電による火災などの安全リスクを効果的に防ぎ、電動車の安全管理を実現します。

●顔識別

類似度のパーセンテージを出力します。

●侵入者識別

危険エリアを自動的に識別し、人員が事前に設定された危険エリア(立入禁止区域)に侵入した場合には、

直ちに警報を発して従業員の身体の安全を確保します。危険エリアには、例えば石炭輸送ベルトや石炭破砕機などが含まれます。

このアルゴリズムの精度は90%以上であり、人手による監視効率を大幅に向上させる効果があります。

●人集め認識

特定のエリアで多人数の集合が発生する状況を監視し、突発事件の予警報や現場の安全管理などを実現します。

商業施設の入口、体育館の入口、細い路地などの場所に適用されます。

●火炎認識

直ちに警報を発して監視室に確認を促し、タイムリーに損失を防ぐ。室内外の様々な複雑な環境に適用可能です。

他に画像認識で活用分野でもよいです、建築現場安全見守り、店舗内集客、ビル管理システム、オフィス社員行動分析、物流倉庫荷物集計、駐車場車両ナンバー認識等

詳しくはメール(info@csun.co.jp)に問い合わせをください。

●各種基板またはOEMでお客様のロゴでも載せる

●webRTCミドルウエア提供、クライアント側とサーバーが両方があり、P2Pライブビデオ、録画、ダウンロード機能を素早く実現

●カスタマイズ開発環境を提供、勿論、AI動作可能の環境もある

●AIアルゴリズム受託開発も受け入れ、基本的に5-6週間完了

●クライアント側、サーバー側のアプリも受託開発可能(別途相談)

上記ソリューションポイントにより、AI開発能力ない企業としても自社の業務により、素早くAIシステム導入可能です。弊社は、プロフェッショナルなカメラモジュールとAI画像処理ソリューションの専門プロバイダとなり、HWと合わせてAI活用を安く早く実現する

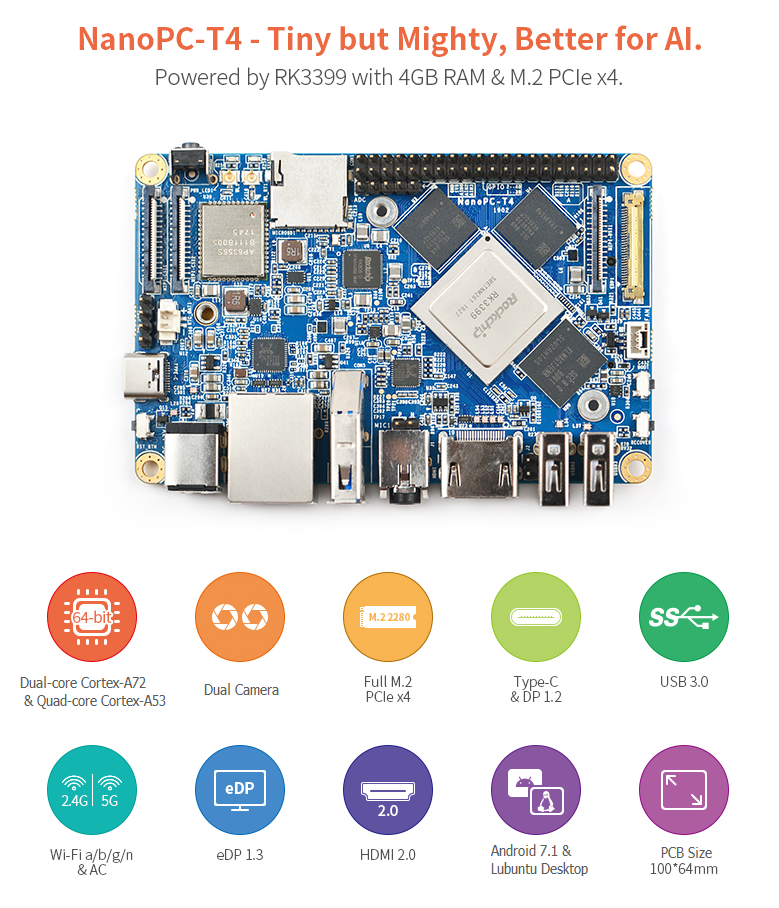

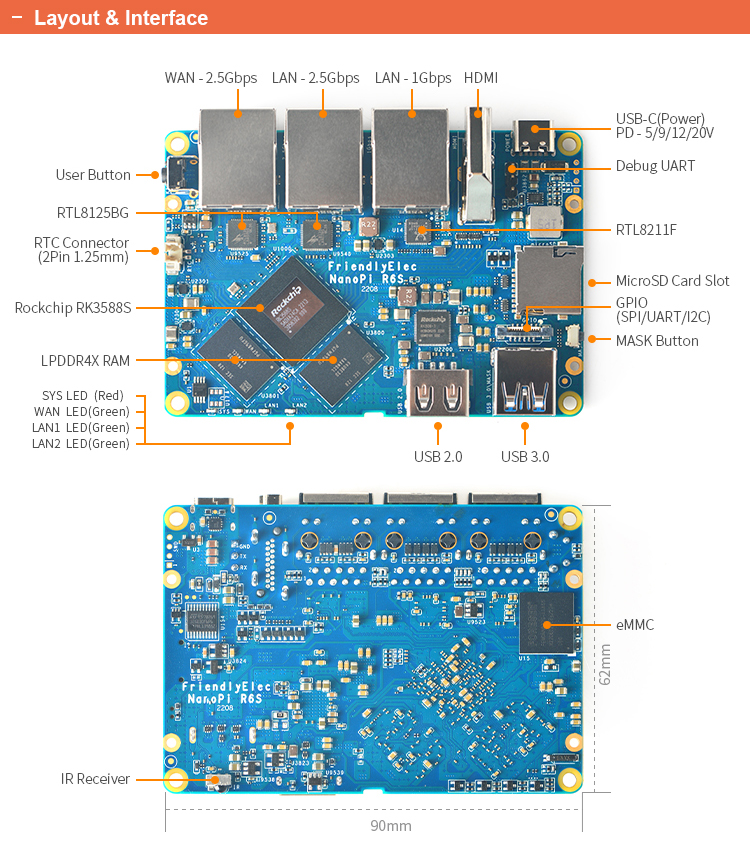

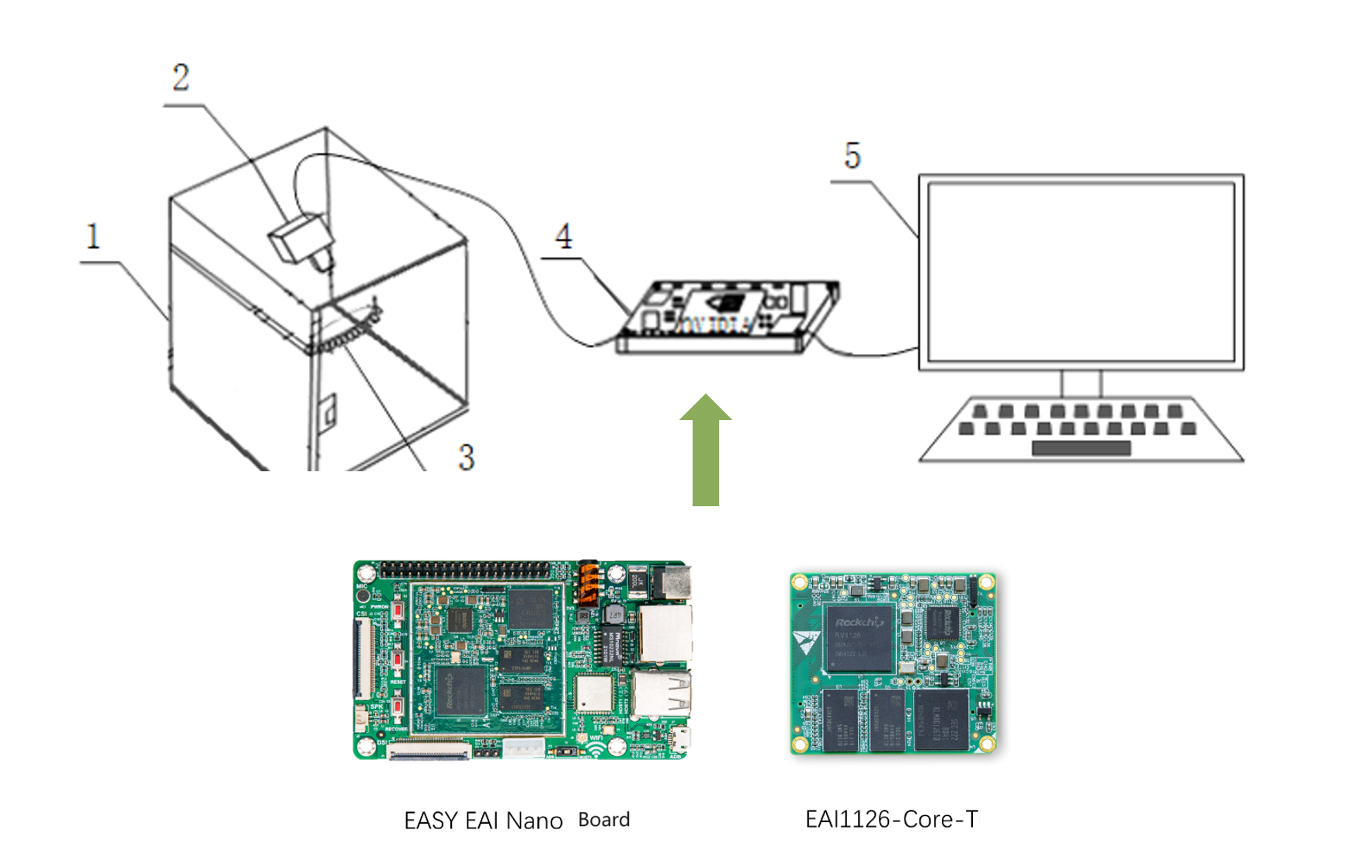

●CSAI1126評価基板(詳しくは下記リンクをクリック)

●WebRTCミドルウエア導入(AIカメラ本体、iPad、PC Web側、クラウドサーバー側はすべてある)

※ライセンス料金についてはホームページから問い合わせをください。

●AIアルゴリズムカスタマイズ開発可能

一般的に、受注してから5-6週間完了見込みです。

- 2024.03.24

- 23:41

- コメント (0)

建築現場の運用事例

●建築業界は都市建設の経済発展にとって重要な支柱ですが、建築業界はまた安全事故が頻発する高リスクの業界でもあります。

●建設関連部門は建築現場の安全施工に対する監督強度を日増しに強化しています。

●規定によると、現在どの建築現場でも施工中に発生するさまざまな安全でない要因をリアルタイムで監視するために、ビデオ監視装置の設置が義務付けられています。

●AI技術運用により健全で安全な建築現場環境が構築されます。

このモニタソリューションは、遠距離カメラを用いて火災を監視し、火事の存在を判断するとともに、建築作業員の行動をモニタすることができます。

例えば、喫煙行為、作業服の着用状況、安全ヘルメットの着用などをチェックし、禁止エリアでの人体認識を行い、侵入者がいないかを判断します。

モニタソリューションは顔認識にも対応し、ゲートでの出勤時間を記録し、現場内の全員をリアルタイムでモニタし、非作業員の存在を判別します。

オンボードのディスプレイでデータのインタラクションを行い、システム設定や人員情報の入力が可能です。

内蔵のTFカードはモニタ情報をローカルに保存でき、モニタ情報はギガビットイーサネット、Wi-Fi、4G/3G/2Gなどの通信方法でサーバーにアップロードすることもできます。

また、クラウドから人員情報を入力することも可能です。ソリューションにはスピーカーが統合されており、従業員の不適切な行動を検出した際には音声でアラートを出すことができます。

(1)ソリューションの電源供給

ソリューションの電源供給方式は9~36Vの直流電源入力で、電源入力端には静電気、グループパルス、雷サージなどの干渉を耐えることができる信頼性の高い保護回路が設計されています。同時に、電源インターフェース入力の高調波などの干渉信号をフィルタリングし、内部干渉信号が外部電源に出力されるのを防ぎます。

(2)ソリューションのUSBインターフェース

このソリューションには合計5つのUSBインターフェースがあり、そのうち2つはUSB Deviceで、ソフトウェアデバッグに使用されます。2つのUSB2.0 Hostインターフェースと1つの標準USB 3.0インターフェースは、USBインターフェースの外部デバイスを挿入するために使用されます。

(3)ソリューションのインタラクションインターフェース

ソリューションのインタラクションインターフェースには、抵抗タッチ機能付きディスプレイとスピーカーがあります。ディスプレイはデータの直接確認やシステム設定に使用され、スピーカーは放送と違反行為を検出した後の音声アラートに使用されます。

(4)ソリューションのカメラ

このソリューションでは、遠距離撮影機能を持つカメラが選ばれ、現場のビデオ入力とAIアルゴリズムのデータ取得に使用されます。各装置で広範囲を監視でき、建築現場のような広い範囲の監視に適しています。

(5)ソリューションの通信インターフェース

ソリューションには、ギガビットイーサネット、Wi-Fi、4Gモジュール(7モード全網対応)などの通信インターフェースがあり、異なる方法でネットワークに接続し、装置のデータをリアルタイムでアップロードし、サーバーからの指示を受け取ることが保証されます。

(6)ソリューションのその他の外部デバイス

ソリューションにはRTC、TFカード、予備の通信インターフェースなどの外部デバイスがあります。RTCは時計計時用で、装置に時間の参照を提供します。TFカードはデータをローカルに保存できます。

予備のSPI、I2C、UARTインターフェースは、様々な種類のセンサー外部デバイスを外部接続するために使用できます。

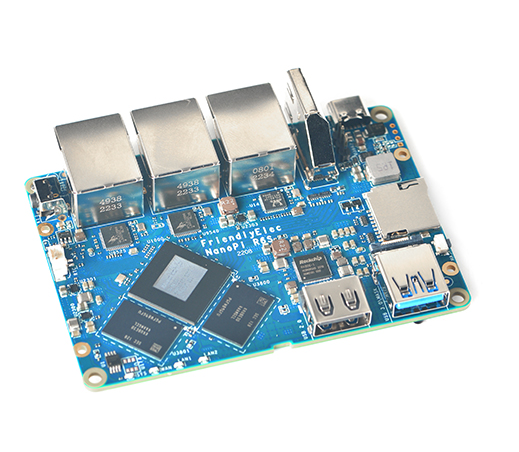

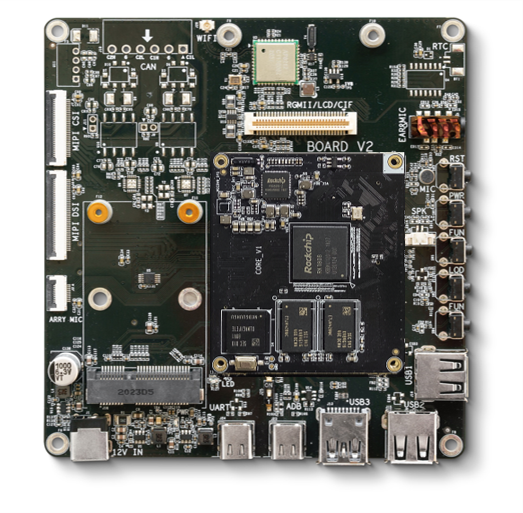

●ソリューションに使われる基板様子:

AIOT1808は、RK1808プロセッサ(デュアルコアCortex™-A35アーキテクチャ)をベースとした工業用マザーボードです。

内蔵のNPUはピーク性能が3.0TOPsに達し、INT8/INT16/FP16の混合演算をサポートし、TensorFlow/MXNet/PyTorch/Caffeなどの一連のフレームワークのネットワークモデル変換に対応し、

互換性が強いです。VPUビデオ処理ユニットは1080Pビデオのエンコード/デコードをサポートし、内蔵ISP、マイクアレイ、ハードウェアVAD機能をサポートし、

低消費電力で遠距離からのウェイクアップをリッスンします。コアボードは顔認識、喫煙検出、火炎検出、安全ヘルメット検出、作業服検出など、

各種AIアルゴリズムを内蔵し、顧客の二次開発に完全なLinux開発パッケージを提供します。

AIOT1808メインボードは豊富な周辺デバイスリソースと完全なインターフェイスを備えています。

ギガイーサネット、Wi-Fi、4Gモジュールなどの通信周辺デバイスが統合されています。

遠隔カメラ、ディスプレイ(抵抗タッチ付き)、スピーカーなどのインタラクション周辺デバイス。

2チャンネルのUSB Hostインターフェイス、1チャンネルのUSB3.0インターフェイス、2チャネルのUSB Deviceデバッグインターフェイス。

RTC、TFカードなどの一般的な周辺デバイス。SPI、I2C、UARTなどの予備インターフェイス。

工業用温度範囲-40℃~85℃で安定して動作し、さまざまな過酷な工業用アプリケーションに対応し、信頼性が高いです。

以下はメインボードのハードウェア仕様です。

●コア:デュアルコアCortex™-A35、動作周波数1.6GHz;

●内蔵NPU:最大算力3.0TOPs;

●内蔵VPU:1080Pビデオエンコード/デコードをサポート;

●メモリ:1GB DDR3;

●eMMC:8GB;

●イーサネット:1チャネルのギガビットイーサネット;

●4Gモジュール:2G/3G/4Gをサポート;

●Wi-Fi:2.4GHz;

●USB:2チャネルのUSB 2.0 Host、2チャンネルのUSB 2.0 Device、1チャンネルの標準USB3.0;

●カメラ:遠距離高解像度カメラ;

●ディスプレイ:解像度1920*1080、抵抗タッチ付き;

●オーディオ出力:外部スピーカーをサポート;

●RTC:高精度リアルタイムクロック;

●TF:最大256G容量をサポート;

●ボタン:1つのリセットボタン、1つの電源ボタン、2つの機能ボタン;

●予約されたUARTインターフェース:5チャンネル;

●予約されたSPIインターフェース:2チャンネル;

●予約されたI2Cインターフェース:2チャンネル;

●供給電圧:直流9~36V;

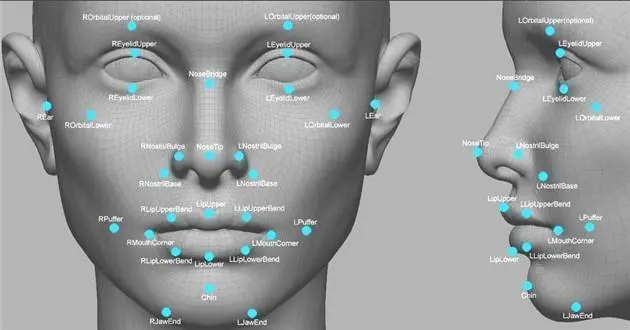

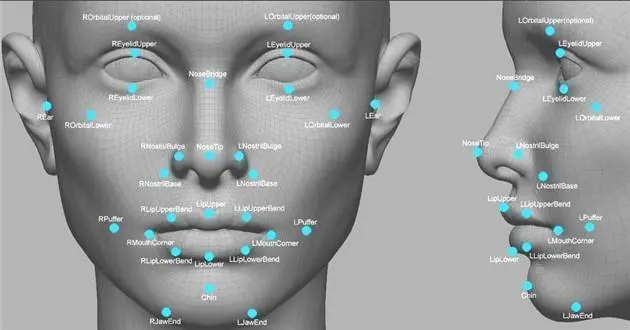

(1)顔認識

顔認識は、顔検出、顔のキーポイント位置特定、顔の校正、特徴抽出、特徴比較など、複数のアルゴリズムで構成されています。アルゴリズムの精度は国際標準LFWデータセット上で99.7%、FAR=0.001に達しています。また、複数人を同時に認識し、双眼生体検出機能をサポートします。

(2)喫煙検出

建築現場には可燃性の建築材料が存在するため、一部のエリアでは喫煙が禁止されています。喫煙検出は、効率的な目標検出アルゴリズムを使用し、画像内に喫煙者がいるかどうかをリアルタイムに検出します。

(3)人員検出

建築現場内の一部エリアは人の立ち入りが禁止されているため、これらのエリアでの人員検出が特に重要です。人員検出は、効率的な目標検出アルゴリズムを使用し、画像内に人がいるかどうかをリアルタイムに検出します。

(4)安全ヘルメット検出

現場では安全ヘルメットの着用が必須で、人命安全を守るために必要です。安全ヘルメット検出アルゴリズムは、規定に従って安全ヘルメットを着用していない違反者がいるかどうかを検出し、

安全ヘルメットを着用している人数と違反者の人数をリアルタイムで統計します。

(5)明火検出

現場で明火が発生すると、非常に重大な結果を引き起こす可能性があります。明火検出は、効率的な目標検出アルゴリズムを使用して火災の発生をリアルタイムに検出し、重大な生命安全事故を避けるために使用されます。

(6)作業服検出

作業服検出はカスタマイズされたアルゴリズムで、お客様が作業服のデータサンプルを提供し、当社と協力してこのアルゴリズムを完成させる必要があります。

●AIOT1808基板またはOEMでお客様のロゴでも載せる

●webRTCミドルウエア提供、クライアント側とサーバーが両方があり、P2Pライブビデオ、録画、ダウンロード機能を素早く実現

●カスタマイズ開発環境を提供、勿論、AI動作可能の環境もある

●AIアルゴリズム受託開発も受け入れ、基本的に5-6週間完了

●クライアント側、サーバー側のアプリも受託開発可能(別途相談)

上記ソリューションポイントにより、AI開発能力ない企業としても自社の業務により、素早くAIシステム導入可能です。弊社は、プロフェッショナルなカメラモジュールとAI画像処理ソリューションの専門プロバイダとなり、HWと合わせてAI活用を安く早く実現する

●AIOT1808評価基板(詳しくは下記リンクをクリック)

●WebRTCミドルウエア導入(AIカメラ本体、iPad、PC Web側、クラウドサーバー側はすべてある)

※ライセンス料金についてはホームページから問い合わせをください。

●AIアルゴリズムカスタマイズ開発可能

一般的に、受注してから5-6週間完了見込みです。

- 2024.03.21

- 20:22

- コメント (0)

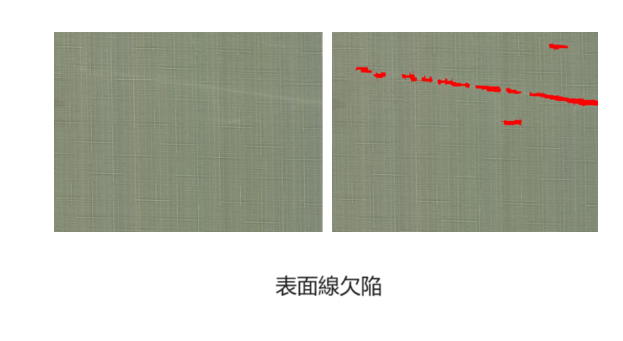

欠陥認識ソリューション

●繊維品の欠陥自動検出装置は、機械、電子、光学、コンピュータ、ソフトウェア工学などを一体化し、機械ビジョン装置を利用して人間の目に代わり検出、測定、判断を行います。

●非接触、再現性、信頼性、高精度、連続性、高効率、柔軟性に優れた特長を持ち、人間による作業が適さない危険な環境や、人間の視覚が精度や速度の要求を満たせない場合、

または大量生産の工業現場など、幅広く応用されています。

●欠陥認識ソリューションフレームワーク図

自動探知、欠陥の位置特定、不良分類を機械ビジョンで検出する方法を集約し、検出結果の精度を大幅に向上させることが可能です。

下記欠陥認識図通り参照頂ければとおもいます。

●(1) 布検査の単独工程を免除し、労働量を削減します。

●(2) 布検査機全体と比較して、この方法は比較的シンプルで、コストも低いです。

●(3) 検査対象の物理状態が良好で、積み重ねによるしわが布検査の精度に影響を及ぼすのを避けます。

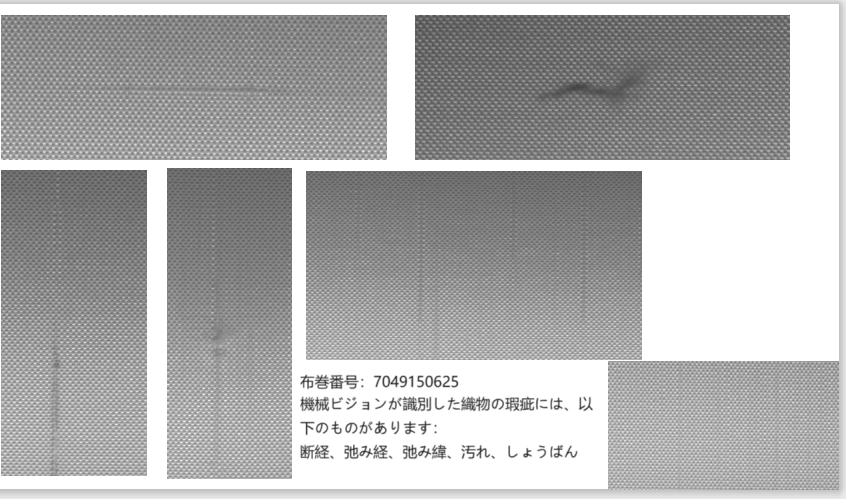

当社のCSAI1126シリーズ製品を使用すると、繊維製品の検査において次のことが実現できます:▶ 欠陥学習機能

システムは使用中に欠陥の形態について学習し最適化を行い、検出精度を継続的に向上させることができます。

▶ 布辺検出

布地の端が損傷するのを検出し、1センチメートル以上の端の欠陥を識別することができます。

▶ 停止アラーム

ユーザーの設定に基づき、重大な欠陥が発生した際にシステムが自動で停止し、音声で警報を発する。

▶ 欠陥マーキング

欠陥を検出した後、高速マーキングシステムを利用して布の端に瞬時にマーキングを行い、人手での後処理を容易にする。

▶ 欠陥レポート

欠陥が発生したメートル数、カテゴリー、画像形態を記録し、各ロールの布に対して一つの欠陥検出レポートを生成する。

レポートの様子:(システムが中国語を使われる)

他に画像認識で活用分野でもよいです、建築現場安全見守り、店舗内集客、ビル管理システム、オフィス社員行動分析、物流倉庫荷物集計、駐車場車両ナンバー認識等

詳しくはメール(info@csun.co.jp)に問い合わせをください。

●CSAI1126コア基板またはOEMでお客様のロゴでも載せる

●webRTCミドルウエア提供、クライアント側とサーバーが両方があり、P2Pライブビデオ、録画、ダウンロード機能を素早く実現

●カスタマイズ開発環境を提供、勿論、AI動作可能の環境もある

●AIアルゴリズム受託開発も受け入れ、基本的に5-6週間完了

●クライアント側、サーバー側のアプリも受託開発可能(別途相談)

上記ソリューションポイントにより、AI開発能力ない企業としても自社の業務により、素早くAIシステム導入可能です。弊社は、プロフェッショナルなカメラモジュールとAI画像処理ソリューションの専門プロバイダとなり、HWと合わせてAI活用を安く早く実現する

●CSAI1126評価基板(詳しくは下記リンクをクリック)

●WebRTCミドルウエア導入(AIカメラ本体、iPad、PC Web側、クラウドサーバー側はすべてある)

※ライセンス料金についてはホームページから問い合わせをください。

●AIアルゴリズムカスタマイズ開発可能

一般的に、受注してから5-6週間完了見込みです。

- 2024.03.21

- 17:21

- コメント (0)

WebRTCミドルウエア説明及導入、運用

目次

リモートワークが一般的となってきた近年、Web会議システムやライブストリーミング・動画配信サービスなどで活用される場面が増えてきています。

WebRTC(Web Real-Time Communication)プロジェクトの最終目的は、Web開発者がブラウザ(Chrome、FireFoxなど)を基にして、

豊かなリアルタイムのマルチメディアアプリケーションを簡単かつ迅速に開発できるようにすることです。

これにより、どんなプラグインもダウンロードやインストールする必要がなくなります。

Web開発者は、マルチメディアのデジタル信号処理過程を気にすることなく、単純なJavascriptプログラムを記述するだけで実現できます。

W3Cなどの組織は、すでにJavascript標準APIを制定しています。

また、WebRTCは、複数のインターネットブラウザ間で堅牢なリアルタイム通信のプラットフォームを構築し、

開発者とブラウザメーカー間の良好なエコシステムを形成することを望んでいます。

同時に、GoogleもWebRTCの技術をHTML5の標準の一つにすることを望み、努力しています。

これはGoogleの戦略がいかに長期的であるかを示しています。

1.組み込み端末デバイスWebRTC SDKライブラリサポート

WebRTCアプリケーションのアーキテクチャは巨大で、組み込みデバイスへの移植が難しいです。そのため、以前のカメラはWebRTCをサポートしていませんでした。日昇がプロジェクトを開発するため、

WebRTCをARMなどの組み込みプラットフォームに成功させました。

基本的に現在の組み込みプラットフォームのオペレーティングシステムをサポートしています:arm linux, rtos, liteosなど。

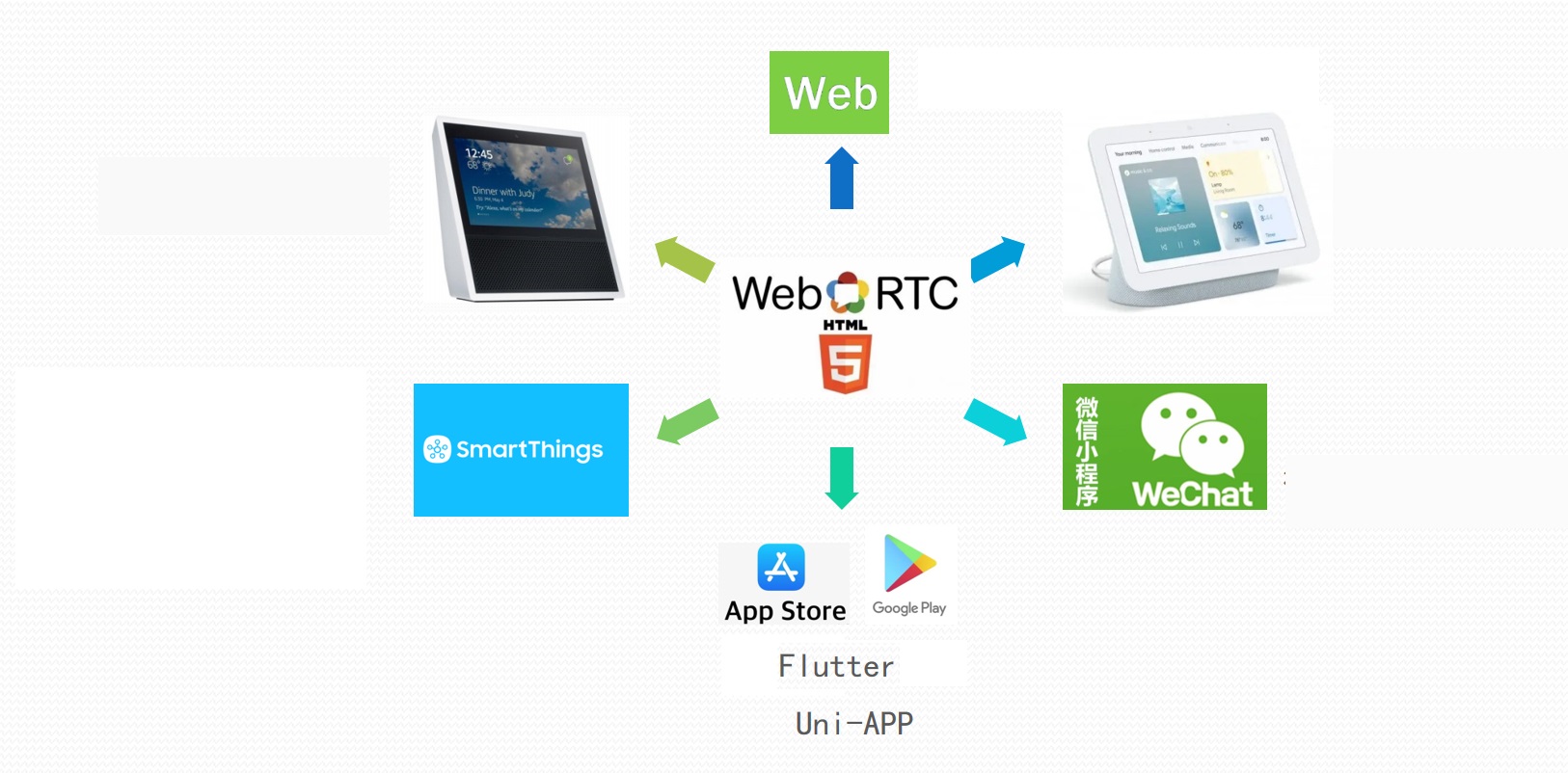

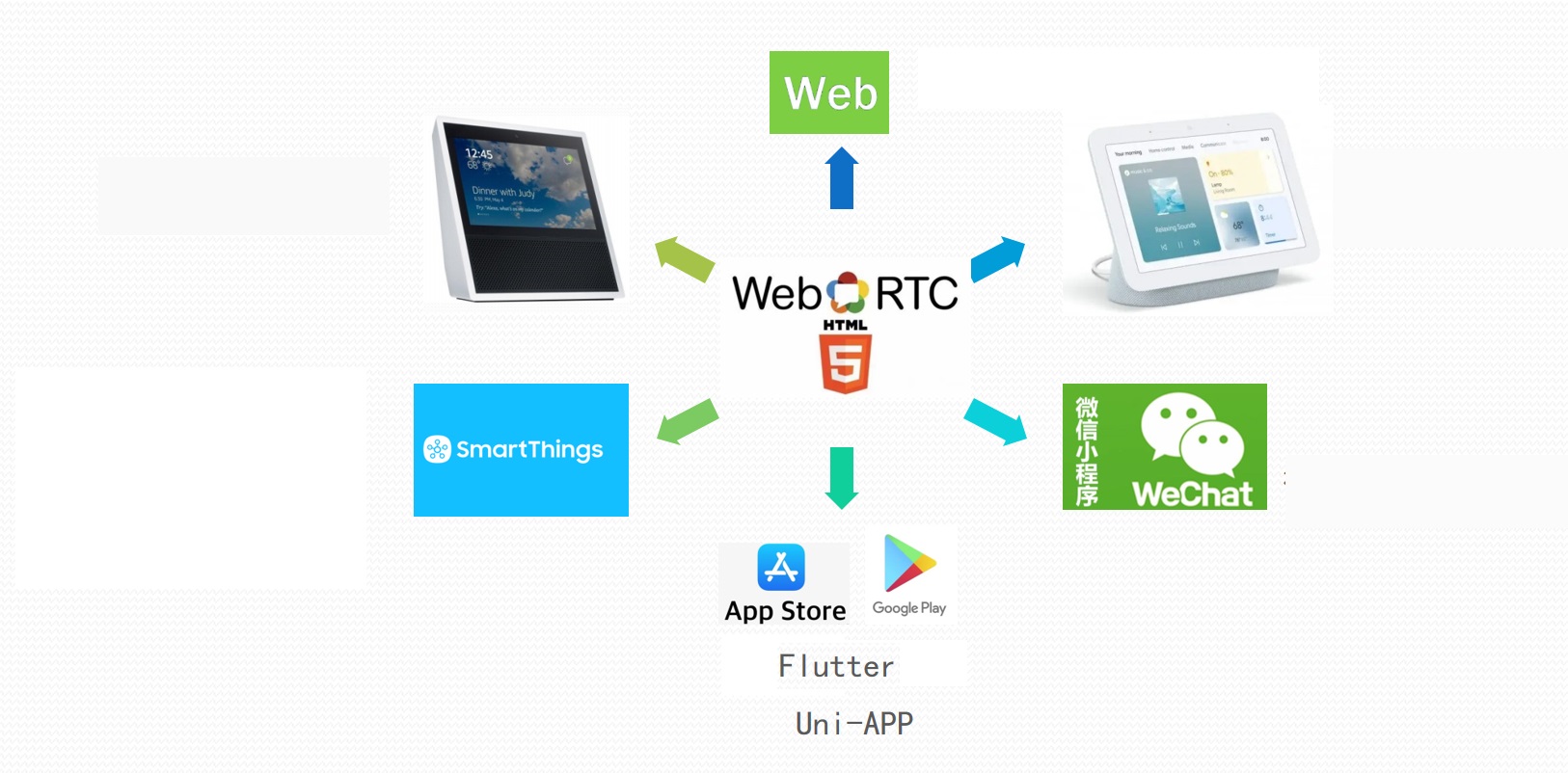

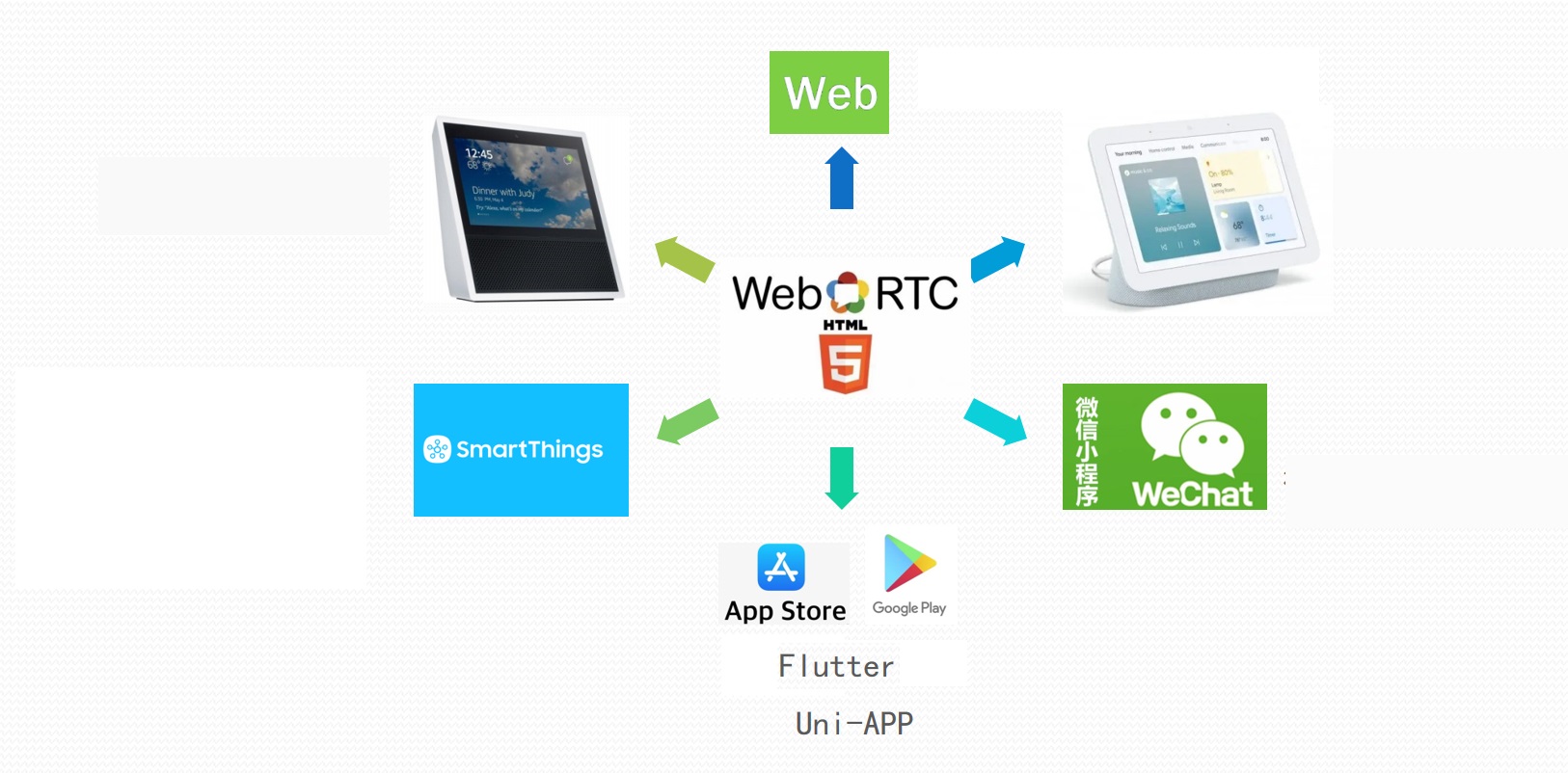

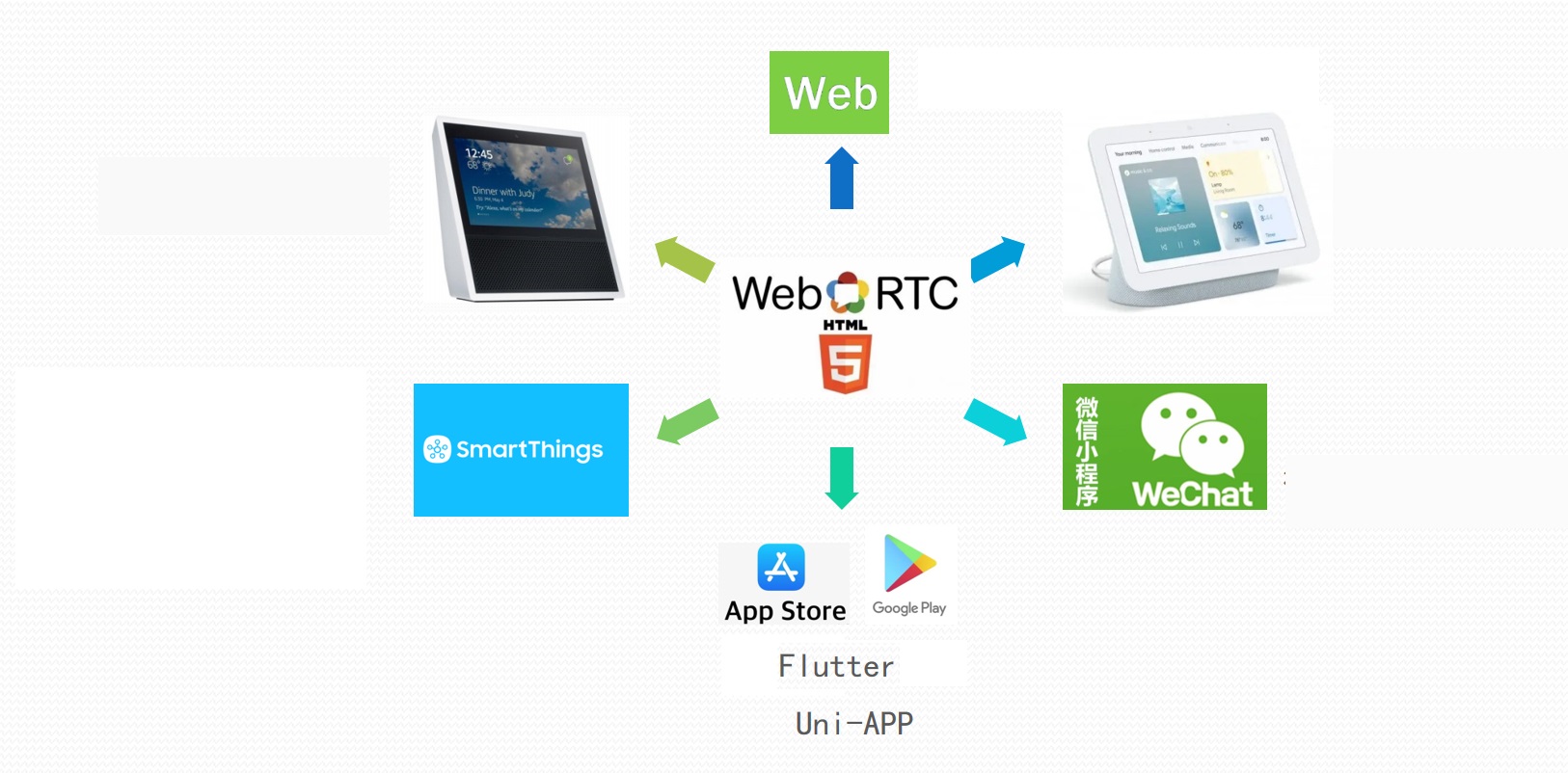

2.WebRTCの強力なクロスプラットフォーム能力

組み込み端末デバイスがWebRTC標準プロトコルをサポートすると、各ブラウザメーカーがWebRTCをサポートしているため、コンピュータ上だけでなく、WindowsやLinuxの使用を実現しました。

さらに、AndroidやIOS上でWebRTC技術を利用して音声通話とビデオ通話を実現することができます。

組み込みデバイスは、複数のプラットフォームでリアルタイムの音声とビデオ通信をサポートできるようになりました。

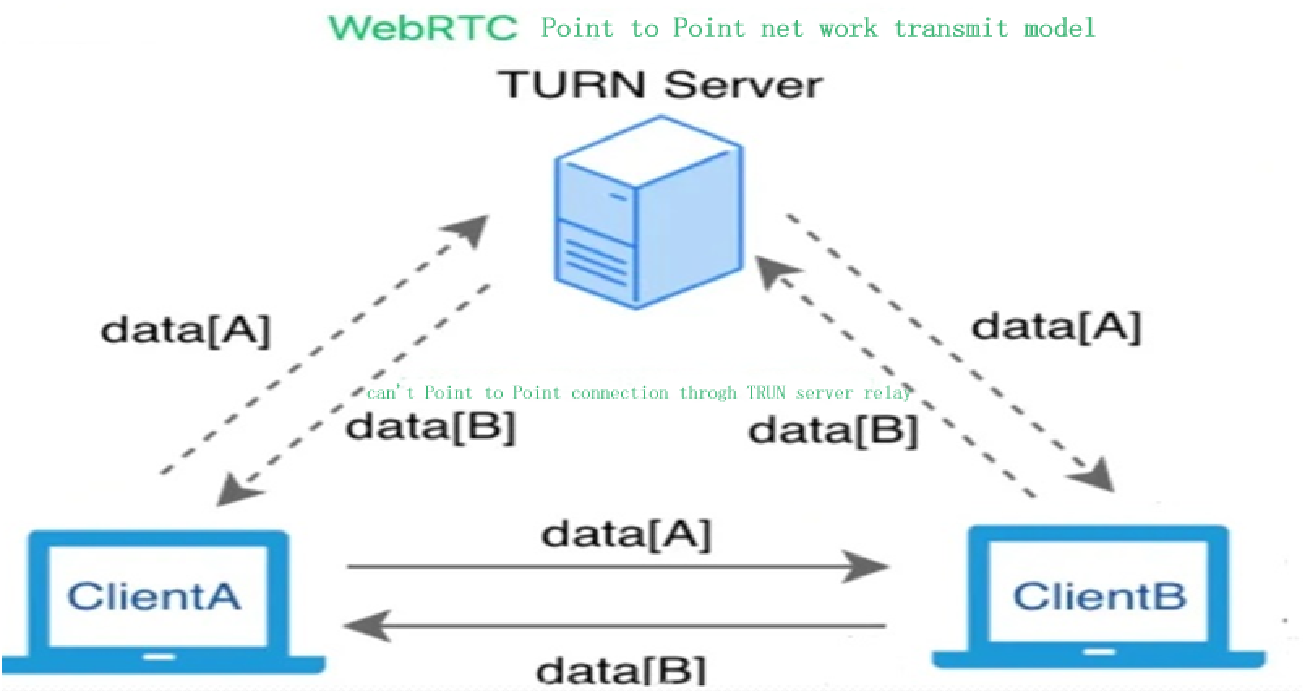

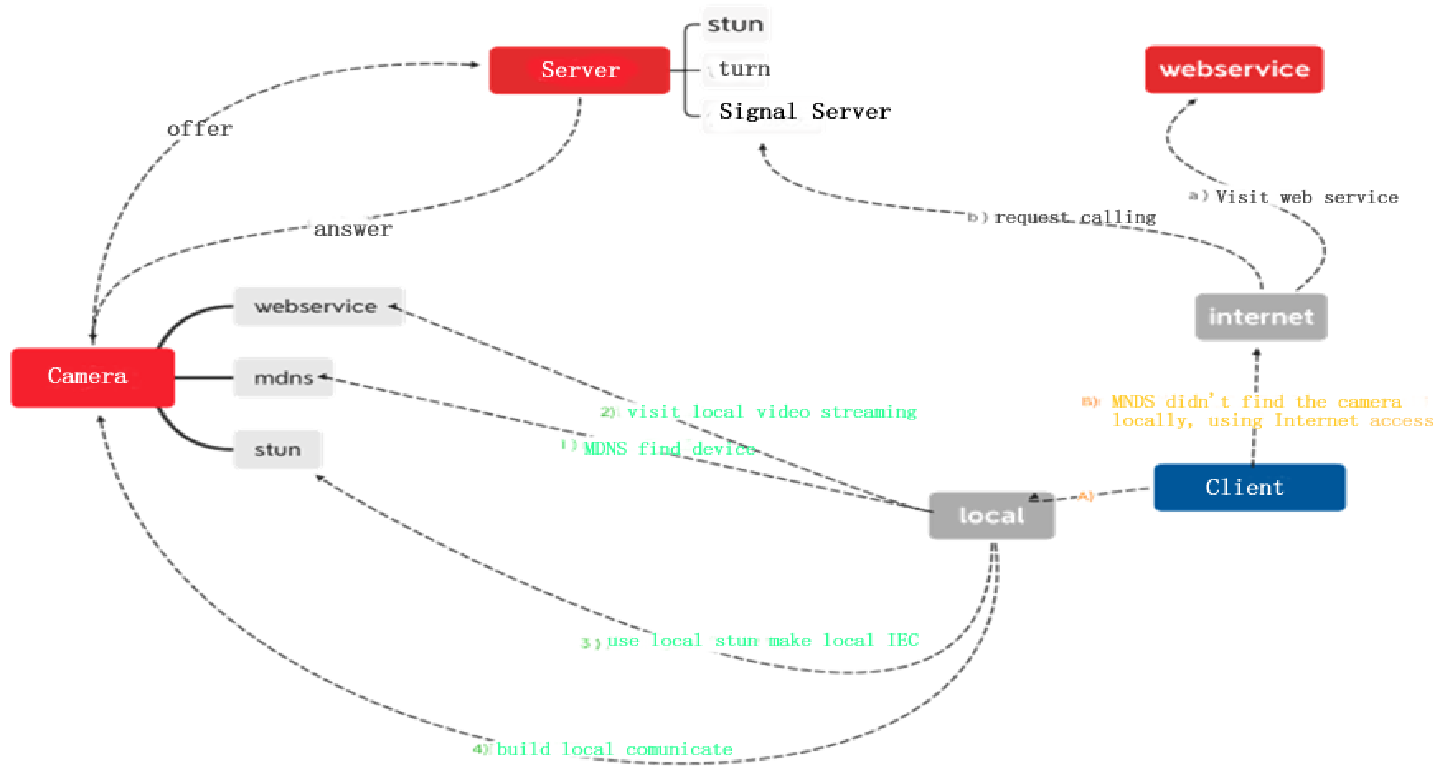

3.強力なNAT越え能力

WebRTC技術には、STUN、ICE、TURN、RTP-over-TCPを使用するNATおよびファイアウォール越えの重要な技術が含まれており、プロキシをサポートしています。ピアツーピアの伝送を実現します。

4.強力な音声・ビデオ処理能力

製品に強力な音声・ビデオ処理能力を付与します。WebRTCは、各フレームの画像を処理でき、輝度検出、色強化、ノイズリダクションなどの機能を含み、ビデオ品質を向上させます。WebRTCは音声データを処理し、エコーキャンセル(AEC)、AECM(AEC Mobile)、自動ゲイン(AGC)、

ノイズサプレッション(NS)、音声活動検出(VAD)などの機能を含み、音声品質を向上させます。

ネットワーク伝送中の音声の最大の問題、ノイズ、エコー、ジッター、自動ゲインの処理問題を解決しました。

5.強力なネットワーク伝送とフロー制御

WebRTCはNetEQ機能も提供しています---ジッターバッファおよびパケットロス補償モジュールで、音質を向上させ、遅延を最小限に抑えます。現在の顧客フィードバックによると、リモートの音声とビデオのリアルタイム伝送は約220msです。

6.強力なデータ暗号化機能

音声とビデオの暗号化はWebRTCの一部であり、ピアツーピアのビデオ通話双方にデータのセキュリティ保証を提供し、Web上でのビデオデータの漏洩を防ぐことができます。

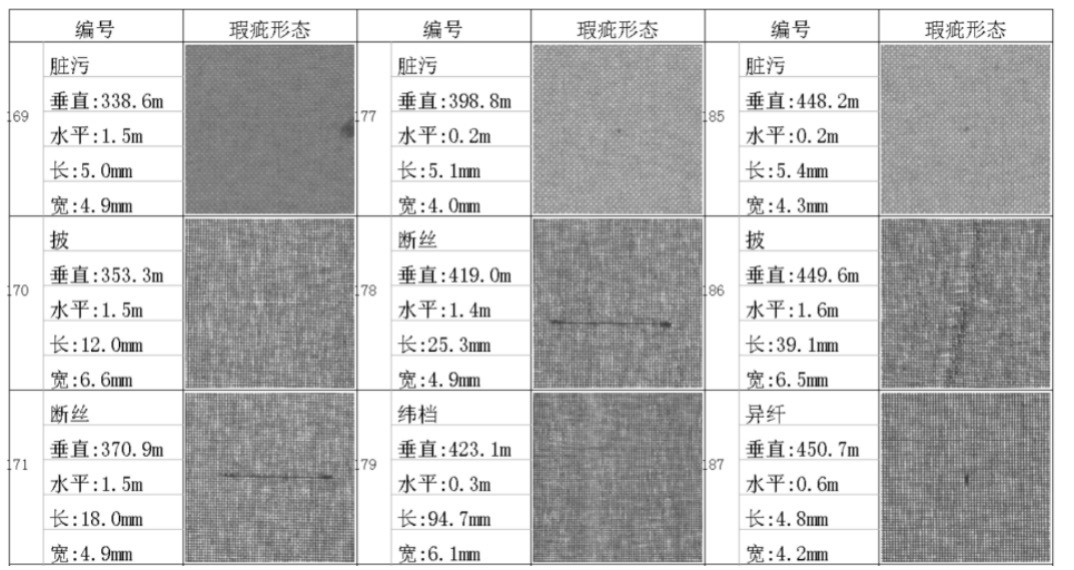

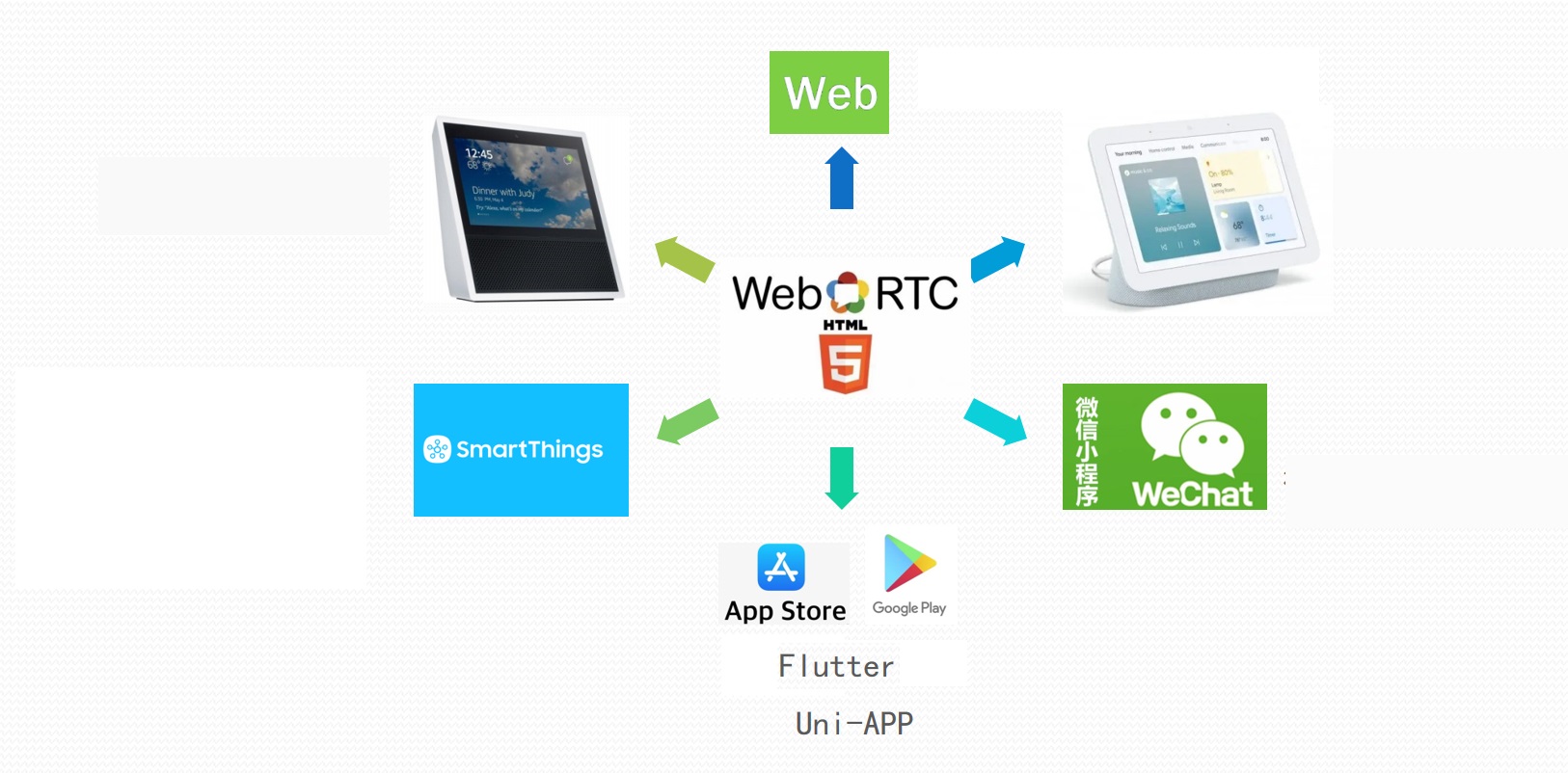

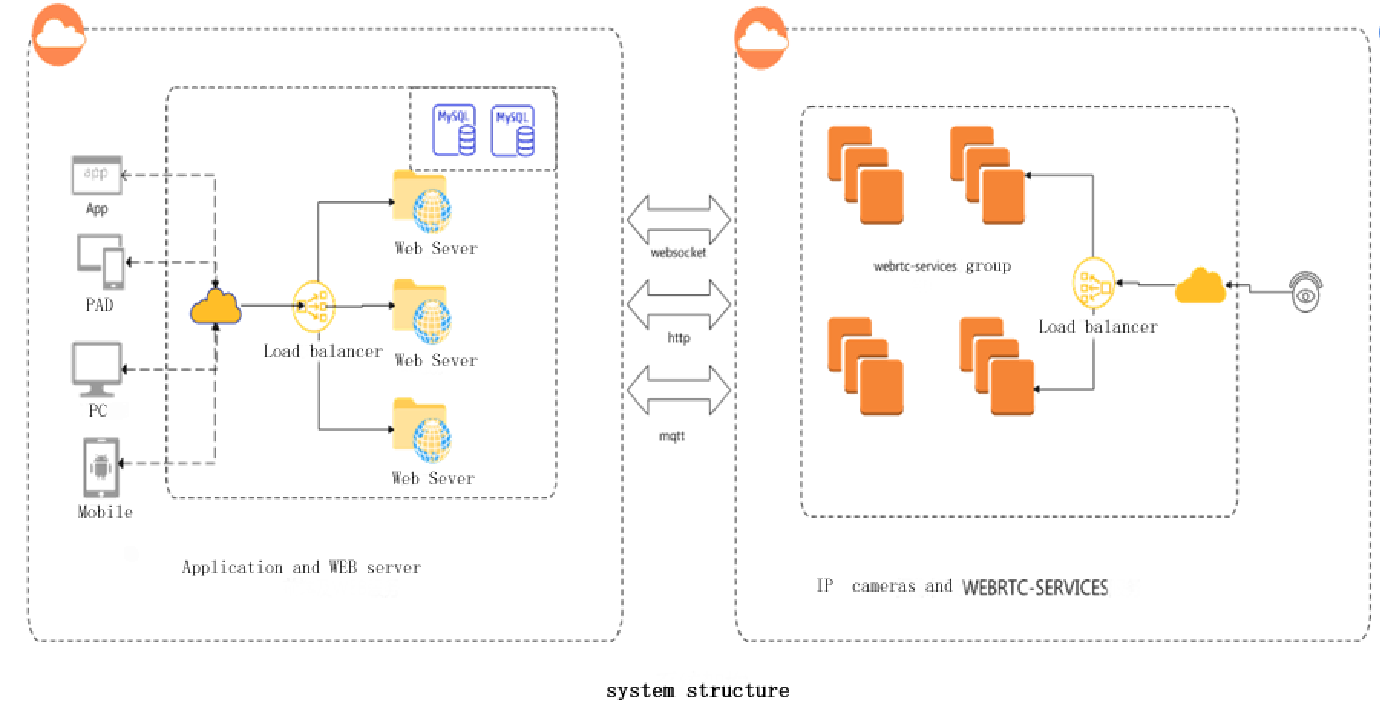

WebRTCシステム構成図

WebRTC P2P通話ネットワークモデル図

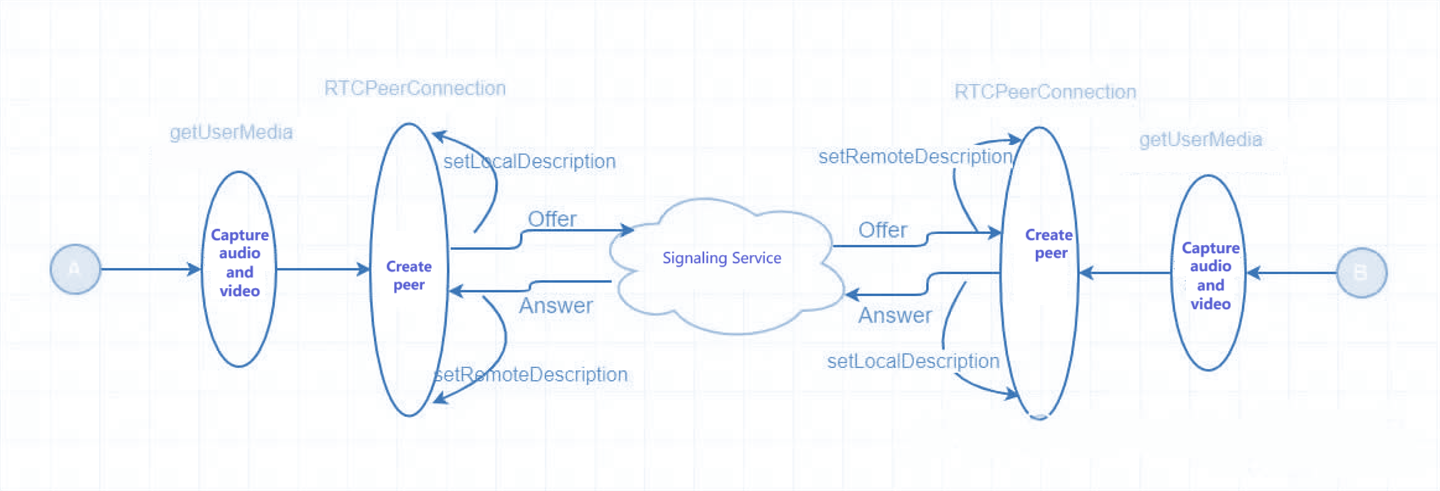

WebRTC P2P通信プロセス図

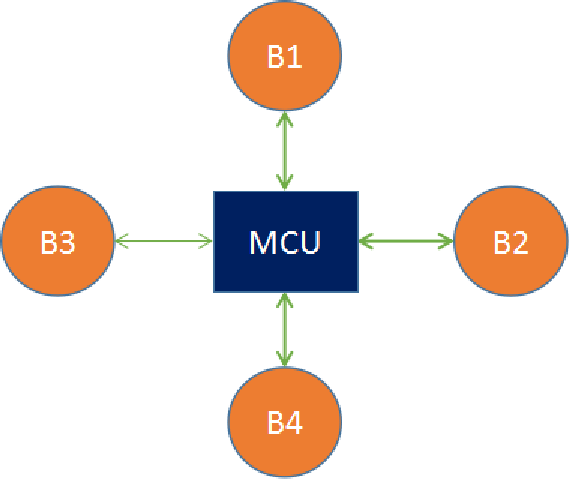

WebRTC MCU(MultiPoint Control Unit)ソリューション

MCUの主な処理ロジックは、各共有端からの音声およびビデオストリームを受信し、デコード後、他のデコードされた音声およびビデオとミックスし、再エンコードした後、

ミックスされた音声およびビデオストリームを部屋の全員に送信することです。

MCU技術はビデオ会議分野で非常に早く登場し、現在の技術も非常に成熟しています。

主にハードウェアビデオ会議分野で使用されます。しかし、今日私たちが話しているのはソフトウェアMCUで、

ハードウェアMCUのモデルと一致していますが、一方はハードウェアで実現され、もう一方はソフトウェアで実現されているだけです。

MCUソリューションのモデルは、以下の図に示すような星形構造です。

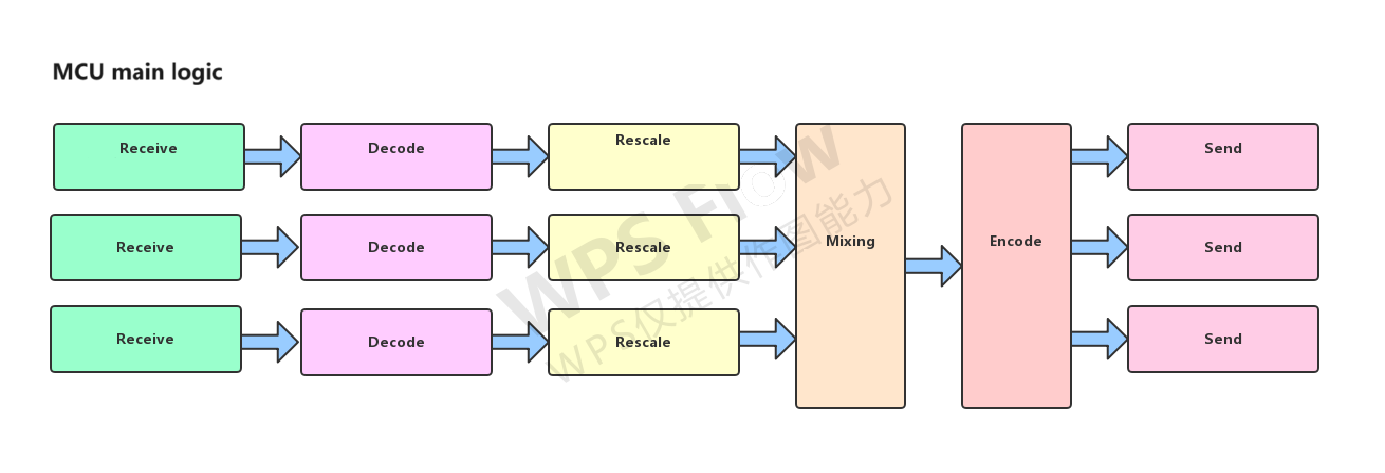

MCUの主要な処理ロジックは、以下の図に示されています:

MCUの主要な処理ロジックは、以下の図に示されています: 1:共有端から送信された音声およびビデオストリームを受信する。

1:共有端から送信された音声およびビデオストリームを受信する。2:受信した音声およびビデオストリームをデコードする。

3:ビデオストリームについては、再レイアウトとミックス処理を行う。

4:音声ストリームについては、ミキシングとリサンプリング処理を行う。

5:ミックス後の音声およびビデオを再エンコードする。

6:受信クライアントに送信する。

2.音声およびビデオゲートウェイとして、デコードおよび再エンコードにより、異なるコーデックデバイスの差異を隠蔽し、

より多くの顧客の統合ニーズを満たし、ユーザーエクスペリエンスと製品の競争力を向上させることができます。

3.複数のビデオを1つのビデオにミックスすると、すべての参加者が同じ画面を見ることになり、顧客体験は非常に良好です。

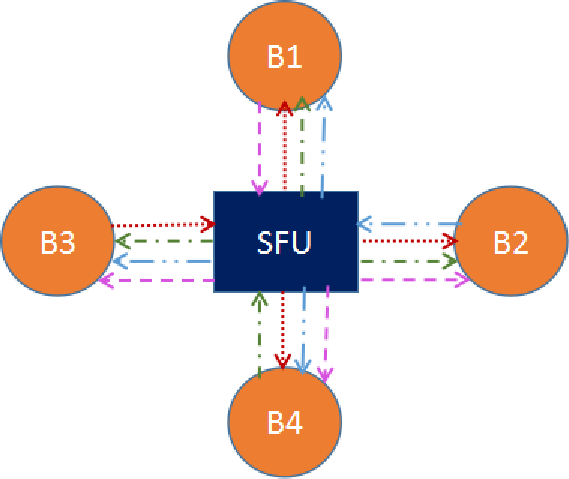

WebRTC SFUソリューション(Selective Forwarding Unit)

SFUはメディアストリームルーターのようなもので、端末からの音声およびビデオストリームを受信し、必要に応じて他の端末に転送します。SFUは音声およびビデオ会議で非常に広く使用されており、特にWebRTCが普及した後です。

WebRTCの多方向通信をサポートするメディアサーバーは、基本的にSFU構造を採用しています。

SFUのトポロジと機能モデルは、以下の図に示されています:

上記の図において、B1、B2、B3、B4はそれぞれ4つのブラウザー/デバイスを代表しており、

上記の図において、B1、B2、B3、B4はそれぞれ4つのブラウザー/デバイスを代表しており、各ブラウザー/デバイスは一つのストリームをSFUに共有します。

SFUは、共有者以外の3つのブラウザー/デバイスにそれぞれのストリームを転送します。

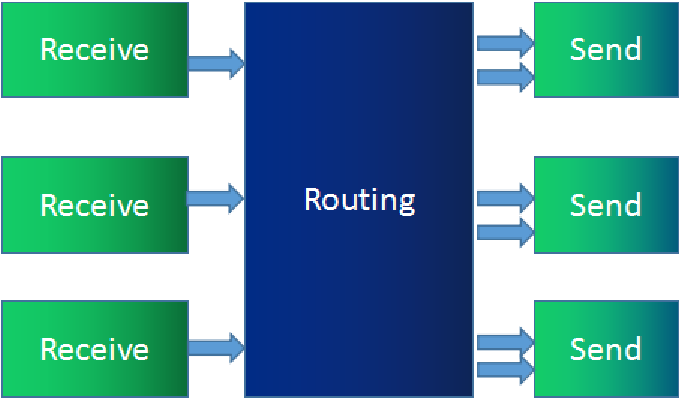

MCUに比べて、SFUは構造がとてもシンプルです。単にストリームを受信して他の人に転送するだけです。

しかし、このシンプルな構造が音声およびビデオの伝送に多くの便利をもたらしています。

例えば、SFUは端末の下りネットワーク状況に応じていくつかのフロー制御を行うことができます。

現在の帯域幅の状況やネットワーク遅延の状況に基づいて、一部のメディアデータを選択的に破棄し、通信の連続性を保証することができます。

日昇WebRTC SFUメリット

以下のような利点があります。1.データパケットを直接転送するため、エンコードやデコードが不要で、必要のCPUリソースが非常に少ないです。

2.直接転送により、遅延が大幅に低減され、リアルタイム性が向上します。

3.非常に大きな柔軟性をもたらし、異なるネットワーク状況や端末タイプにより適応しやすくなります。

Webアプリ、PC、スマートフォン

Web開発者が開発したプログラムで、Web開発者はWebRTCを統合したブラウザが提供するweb APIを基に、ビデオや音声のリアルタイム通信アプリを開発することができます。

PC端末では、標準のWebRTC標準APIを基にH5コードを提供し、アプリケーションの内容を拡張します。

スマートフォン端末では、日昇WebRTCがH5コードまたはFlutterコードを提供し、WeChatミニプログラムやアプリケーションの開発に基づいています。

WebRTC標準APIを基にして、シンプルで効率的な開発が可能です。

Web API

第三者開発者向けのWebRTC標準API(Javascript)で、開発者がWeb上でビデオチャットのようなアプリケーションを容易に開発できるようにします。All One WebRTCサーバーソリューション

stun(P2P)、turn(転送)、SFUストリームメディア配信サービス(Selective Forwarding Unit)、

MCUマルチポイントビデオ会議サービス(MultiPoint Control Unit)、Alexa転送サービス、低消費電力起動サービス、

携帯電話SMS警報サービス、クラウドストレージサービス、MCUルームビデオ会議サービス、信号サービス等を提供しています。

WebRTCのアーキテクチャコンポーネント特徴

●WebRTCは標準APIを通じて信号方式で迅速に第三者プラットフォームにアクセスできます。

●WebRTCは標準APIを通じて信号方式で迅速に第三者プラットフォームにアクセスできます。例えば、アマゾンのAlexa、Google Home、Samsung SmartThings、WeChatミニプログラム、

LINEミニプログラム、第三者SaaSプラットフォームアプリケーションの統合などです。

1.アマゾンのAlexaに接続

a. WebRTC信号サービスがアマゾンのクラスターSFUサービスとハンドシェイクを行い、NAT越えを実現します。

b. アマゾンのAlexaとIPCやビジュアルドアベルとの双方向音声通話を実現します。

c. 機能拡張では、監視チャンネルを切り替えることができます。ドアベルのボタンやモーション検出方式で、Alexaが直接画像をリンクします。

電子制御のドアロックを音声指令で開閉したり、庭の灯りのカメラをオン/オフするなど、多様な操作が可能です。

d. WebRTC信号サービスがAlexaのSFUサービスと信号のハンドシェイクを行いNAT越えした後、WebRTCサーバーの流量コストと帯域幅の圧力を節約します。

2.Google Homeへの接続は完全にSTUN+TURNサービス体系を参考にしています。

どのような方法でローカル通信を確立しても、LAN内でリアルタイムの音声およびビデオを伝送できます。

●カスタム開発の利便性とメンテナンスの容易性

WebRTC標準APIのアーキテクチャにより、アプリケーション端のWeb、WeChatミニプログラム、APPの開発が簡単かつ迅速になります。

H5コードまたはFlutterコードを提供し、パッケージされた内容と標準のWeb APIインターフェースが完全に統合されます。

アプリケーション開発者は、H5またはFlutterを使用してAPPやWeb管理プラットフォームを開発することが、もはや複雑ではありません。

フロントエンドとバックエンドの分離による同時開発により、開発スケジュールが大幅に向上します。

メンテナンス作業も大幅に削減され、一つのコードセットでクロスプラットフォームアプリケーションを完成させることができます。

これは、私たちの開発者や起業家が求めている内容ではないでしょうか?

顧客のニーズに応えるカスタマイズを最速で行い、変動と増加の市場を実現することができます。

市場の複製と開拓は、新たなマイルストーンを迎えるでしょう。

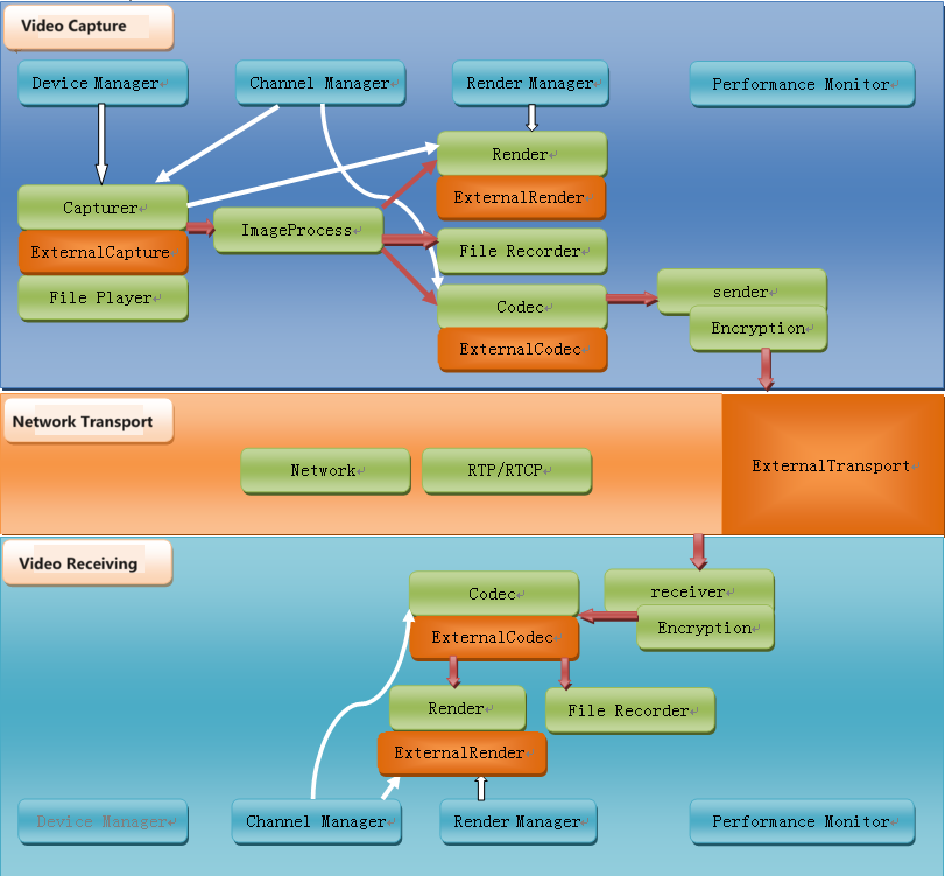

1.WebRTCのビデオ処理分析

WebRTCのビデオ部分には、キャプチャ、エンコード/デコード(I420/VP8)、暗号化、

メディアファイル、画像処理、表示、ネットワーク伝送およびフロー制御(RTP/RTCP)などの機能が含まれます。

A.ビデオキャプチャモジュール---video_capture

A.ビデオキャプチャモジュール---video_captureソースコードはwebrtc/modules/video_capture/mainディレクトリ下にあり、

インターフェイスと各プラットフォームのソースコードが含まれています。

Windowsプラットフォームでは、WebRTCはdshow技術を使ってビデオデバイス情報の列挙とビデオデータのキャプチャを実現しています。

これは、ほとんどのビデオキャプチャデバイスをサポートできることを意味しますが、

専用のドライバが必要なビデオキャプチャカード(例えば、HikvisionのHDカードなど)には対応していません。

ビデオキャプチャは、I420、YUY2、RGB、UYUYなどの複数のメディアタイプをサポートしており、フレームサイズとフレームレートの制御が可能です。

B.ビデオエンコード/デコード---video_coding

ソースコードはwebrtc/modules/video_codingディレクトリ下にあります。 WebRTCは、H.264/I420/VP8/VP9/AV1/FMPEGのエンコード/デコード技術を採用しています。

VP8は、GoogleがON2を買収した後のオープンソース実装であり、WebMプロジェクトでも使用されています。

VP8は、より少ないデータでより高品質のビデオを提供でき、特にビデオ会議のような要件に適しています。

同時に、Flutter APPのコードを提供し、日昇WebRTCはH.265チャネルのサポートをパッケージ化しており、

セキュリティ産業の製品がより高い圧縮比を求めるニーズも容易になります。

C.ビデオ暗号化---video_engine_encryption

ビデオ暗号化はWebRTCのvideo_engineの一部であり、

ビデオアプリケーション層の機能に相当します。P2Pのビデオ通信双方にデータの安全保証を提供し、

Web上でのビデオデータの漏洩を防ぐことができます。

ビデオ暗号化は送信端と受信端でビデオデータの暗号化および復号化を行い、鍵はビデオ通信双方で協議されます。

その代償として、ビデオデータ処理のパフォーマンスに影響を与える可能性があります。

また、ビデオ暗号化機能を使用しないことも可能で、その場合はパフォーマンスが向上するでしょう。

ビデオ暗号化のデータソースは、原始データストリームまたはエンコード後のデータストリームのいずれかである可能性があります。

エンコード後のデータストリームであると想定され、その場合、暗号化のコストは低くなる可能性がありますが、さらに研究が必要です。

D.ビデオメディアファイル---media_file

ソースコードはwebrtc/modules/media_fileディレクトリ下にあります。

この機能は、ローカルファイルをビデオソースとして使用できるもので、ある種のバーチャルカメラの機能に似ています。

サポートされている形式にはAviがあります。

また、WebRTCは音声およびビデオをローカルファイルに録音することもでき、非常に実用的な機能です。

E.ビデオ画像処理---video_processing

ソースコードはwebrtc/modules/video_processingディレクトリ下にあります。

ビデオ画像処理は、各フレームの画像に対して行われ、輝度検出、色の強化、

ノイズリダクションなどの機能を含み、ビデオ品質を向上させるために使用されます。

F.ビデオ表示---video_render

ソースコードはwebrtc/modules/video_renderディレクトリ下にあります。

Windowsプラットフォームでは、WebRTCはDirect3D9およびDirectDrawを使用してビデオを表示します。これが唯一の方法であり、必須です。

G.ネットワーク伝送とフロー制御

ネットワークビデオにおいて、データの伝送と制御は核心的な価値です。WebRTCは、成熟したRTP/RTCP技術を採用しています。

2.WebRTCのオーディオ処理分析

WebRTCの音声部分には、デバイス、エンコード/デコード(iLBC/iSAC/G722/PCM16/RED/AVT、NetEQ)、

暗号化、音声ファイル、音声処理、音声出力、音量制御、音声とビデオの同期、

ネットワーク伝送とフロー制御(RTP/RTCP)などの機能が含まれています。

A.音声デバイス---audio_device

ソースコードはwebrtc/modules/audio_device/mainディレクトリ下にあり、

インターフェースと各プラットフォームのソースコードを含んでいます。

Windowsプラットフォームでは、WebRTCはWindows Core AudioおよびWindows Wave技術を使用して音声デバイスを管理し、

ミキサーマネージャーも提供しています。音声デバイスを利用することで、音声出力や音量制御などの機能を実現できます。

B.音声エンコード/デコード---audio_coding

ソースコードはwebrtc/modules/audio_codingディレクトリ下にあります。

WebRTCは、iLBC/iSAC/G722/PCM16/RED/AVTのエンコード/デコード技術を採用しています。

また、WebRTCはNetEQ機能を提供しています。これはジッターバッファーとパケットロス補償モジュールで、

音質を向上させ、遅延を最小限に抑えることができます。もう一つの核心機能は、音声会議に基づくミキシング処理です。

C.音声暗号化---voice_engine_encryption

ビデオと同様に、WebRTCは音声の暗号化機能も提供しています。

D.音声ファイル

この機能では、ローカルファイルを音声ソースとして使用できます。

サポートされている形式にはPcmとWavがあります。 同様に、WebRTCは音声をローカルファイルに録音することもできます。

E.音声処理---audio_processing

ソースコードはwebrtc/modules/audio_processingディレクトリ下にあります。

音声処理は音声データに対して行われ、エコーキャンセル(AEC)、AECモバイル(AECM)、自動ゲインコントロール(AGC)、

ノイズリダクションなどの機能を含み、音質を向上させます。

F.ネットワーク伝送とフロー制御

ビデオと同様に、WebRTCは成熟したRTP/RTCP技術を採用しています。

■WebRTC拡張について

WebRTCは閉じたシステムではありません。逆に、非常に拡張しやすい構造をしており、

Device、Codec、Render、Transportなど、拡張可能なインターフェースを提供しています。

例えば、H264のCodecを追加することで、既存のシステムへのサポートを容易に追加できます。

組み込みイメージデバイスについては、ネットワーク伝送層を拡張することができます:

ビデオキャプチャ端からエンコードされたデータパケットを得たとき、

それを組み込み端末デバイスのネットワーク伝送を通じて直接、WebRTCサーバーが各アプリケーションクライアントに送信し、

その後WebRTCが受信処理を行うことで、私たちが求める機能を実現します。

■WebRTCアプリケーション拡張について

WebRTCがW3C標準に組み込まれたことで、

すべてのシステムおよびブラウザがWebRTCをサポートしています。

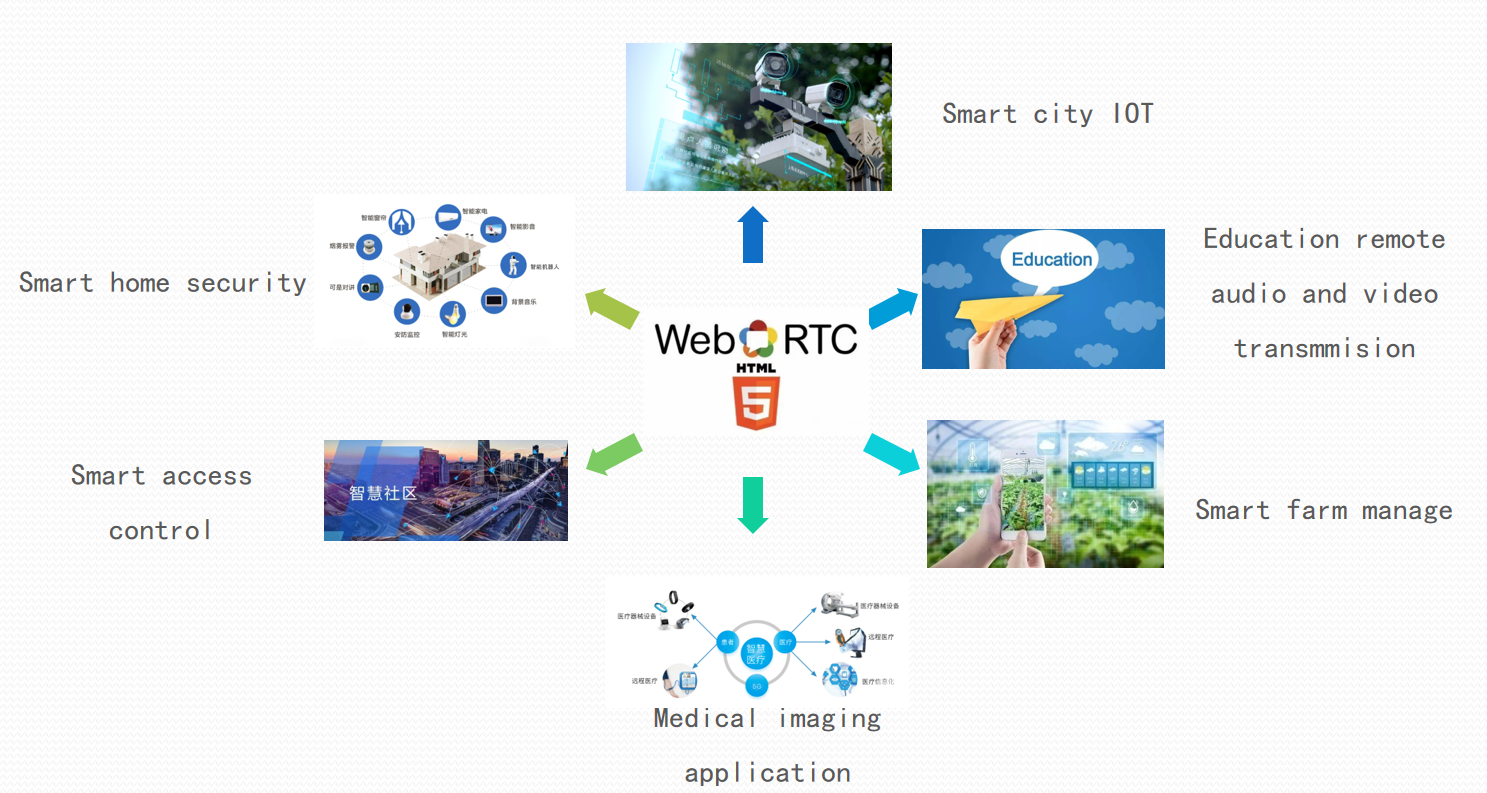

アプリケーションの拡張性は非常に高いです。標準のWebRTC P2P。

1):遠隔オンライン音声ビデオ対話教育業界向け

2):遠隔医療診療および手術ガイダンス向け

3):遠隔農場の可視化物連管理およびアプリケーション向け

4):セキュリティ監視分野で、企業のプラットフォーム開発コストと

ストリーミングメディアサーバーコストを削減。

リアルタイム性が高く、プラットフォームのアーキテクチャとメンテナンスが簡単で容易

5):遠隔音声ビデオサービス、保険業界、遠隔執行業界向け

6):スマートコミュニティの入口管理、スマートケア産業など向け

7):機械ビジョン検索とロボットアームの同期制御には、リアルタイム性が利点です。

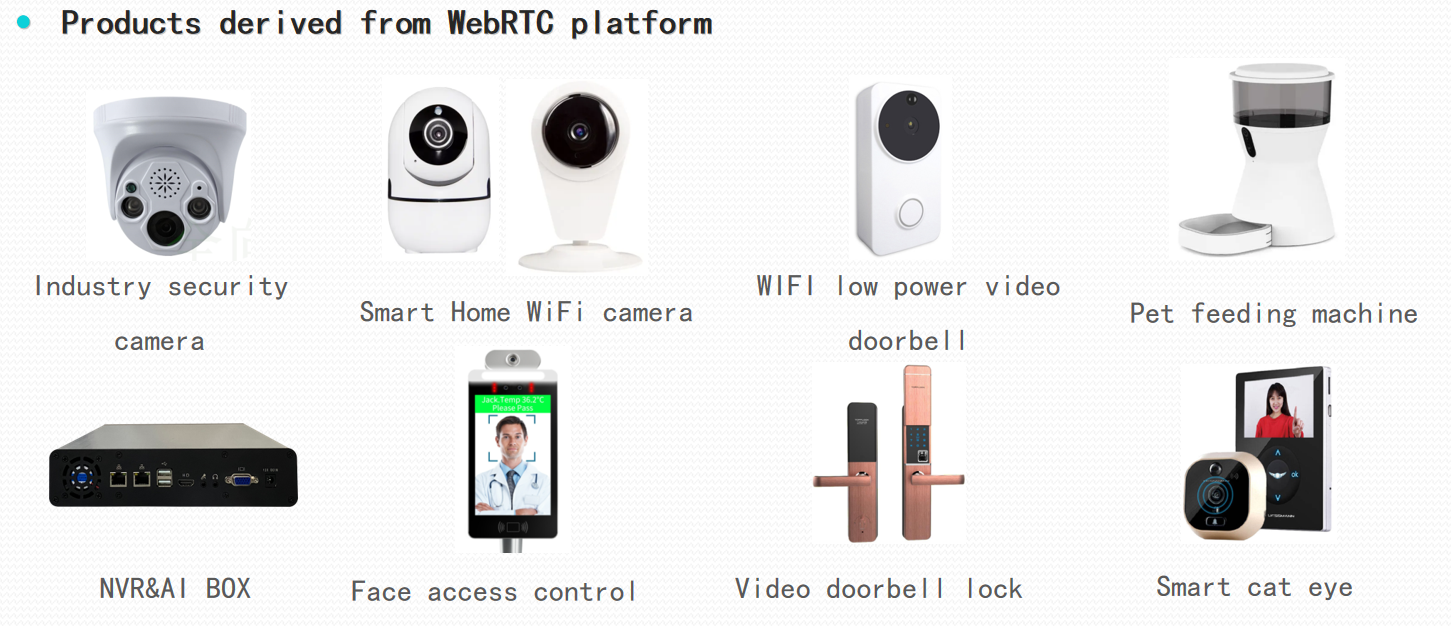

■日昇WebRTCに基づき活用製品

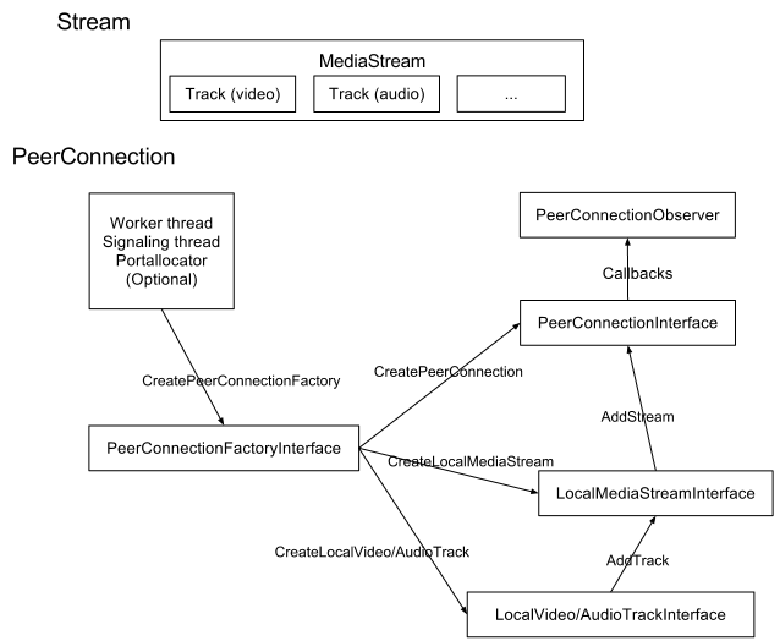

■WebRTC Native APIの機能

WebRTC Native APIはWebRTC specに基づいて実装されており、

RTCアプリケーションの開発者が使用しやすいようになっています。

主にマルチメディアストリームとPeerConnection APIを含んでいます。

■WebRTC Native APIの構造図

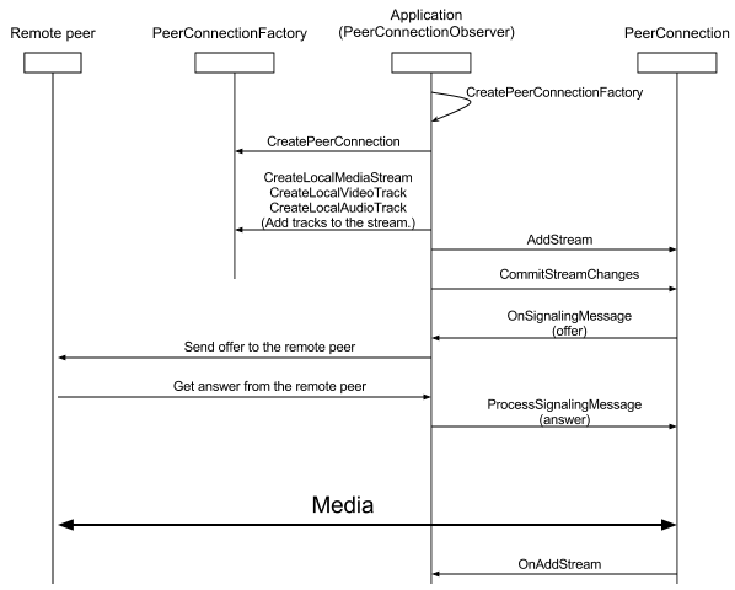

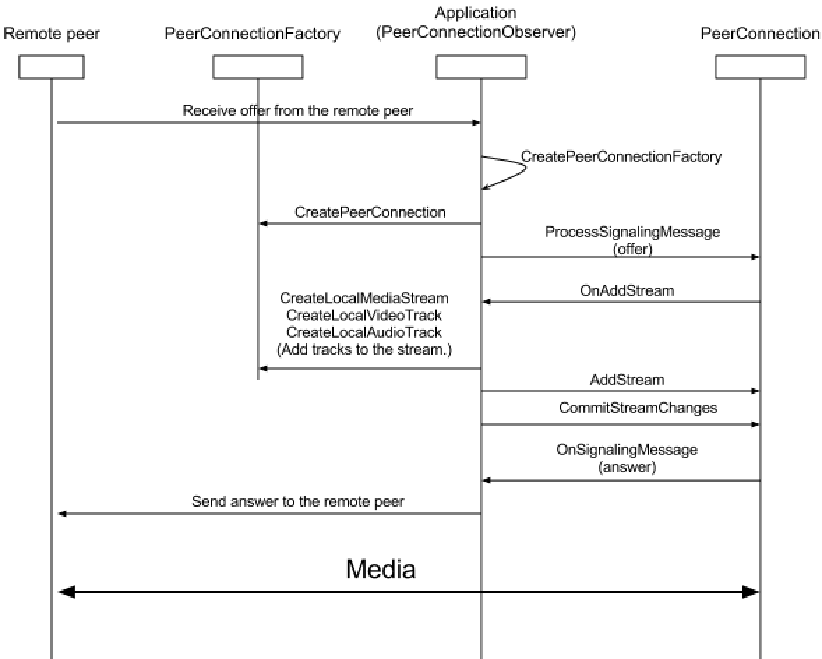

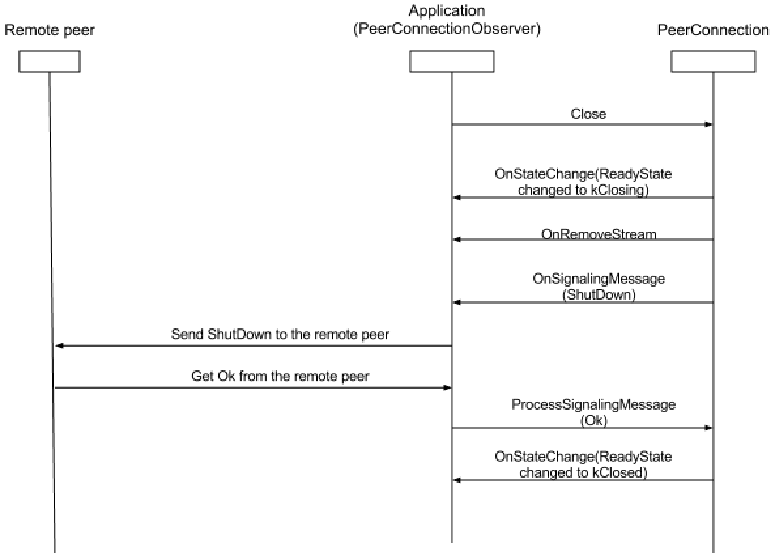

■WebRTC Native APIのシーケンス図

●接続を確立するシーケンス図:

●受信の際にシーケンス図:

●クローズの際にシーケンス図:

端末間でメディア通信チャネルを提供頂ければ、リアルタイム通信を確立し、

画像機器とデバイスやモバイル端末との遠隔音声ビデオ通信が可能になります。

「(Line)」と「WhatsApp」がビデオ通話を確立できるのは、

あなたが日本で携帯電話を使ってアメリカの友人の自宅の固定電話に電話をかけるのと同じです。

なんて素晴らしいことでしょう!この日が早く来ることを推進することは、

私たちインターネット音声ビデオ通信の作業者の歴史的な責任ではないでしょうか?

ここまでWebRTC基本仕組み、日昇WebRTCの特徴、WebRTC活用シーンを解説しました、

では、我々の業務として、どこから始まりますか?

日昇WebRTCとして、ユーザー使いやすさ、製品開発短縮、コスト削減という立場から

作ったものですので、簡単に音声・ビデオ通話システムを構築できます。

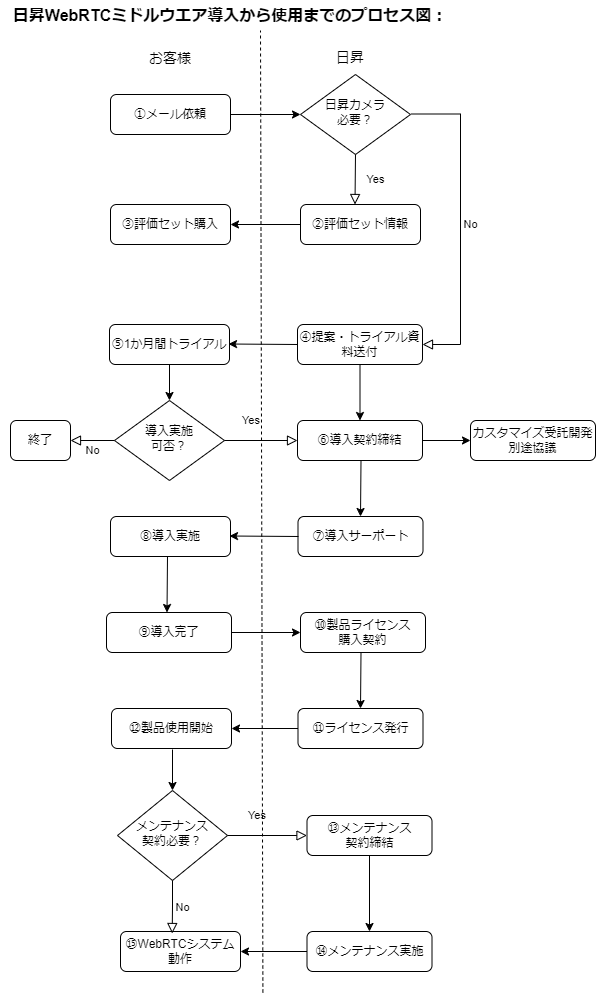

●導入の流れ:

上図通り、導入の流れを説明させていただきます。

上図通り、導入の流れを説明させていただきます。●①お客様からメールで弊社に依頼

問い合わせはhttps://www.csun.co.jpホームページに問い合わせボタンがあります、そこからもできます、または、直接、info#csun.co.jp(#を@に置き換える)に連絡してもよいです。

このメール内容には下記内容が望まれます。

1)会社名、担当者部署、名前、連絡先

2)構築予定の事業分野、業務内容(P2Pライブビデオ、録画、ダウンロード)等の内容

3)日昇カメラを導入するか

弊社のカメラは必要の場合、2種類があります、下記のリンクから購入できます。 4)クライアント側種類(例:カメラ、PC、iPhone、Android携帯、他の組み込みデバイス等)

5)お客様が自社のクラウドサーバーが持っているか(P2Pサーバー構築予定があるか)

●②、④弊社がメールを受信してから提案とトライアル資料をメールで回答

●⑤弊社が提供したトライアル資料に基づき1か月間のトライアルを行う

●導入する場合、⑥導入契約締結を行う

導入契約を作った後、下記作業を進められます。

1)導入手順資料提供

2)各クライアント側用のデモソースも提供

(PC Web、ios/android用のflutter_webrtc_application、組み込み用のデモ、Linux用デモ)

3)P2Pサーバー構築有無、クライアント側の種類により⑦導入サーポートを行う。

※種類の数により、導入サーポート料金は違います。1種類が10万円サーポート

※導入期間は基本的に1か月間、動作確認が1か月間、トライアル期間併せて3か月間

※新規開発によりコスト大幅に削減、期間も短縮

4)開発経験がないお客様は弊社にカスタマイズ開発も受託可能です、その際に、実際システム仕様により見積を行う

●お客様から⑧導入実施を行い、⑨導入完了後、⑩製品ライセンス購入契約を行う

製品ライセンスは二つ場合を分けます。

1)日昇カメラを使わない場合、ライセンスは別途購入必要となります、P2Pサーバーは日昇側のものを使わないであれば、

ライセンス料機は一回購入後、そのバージョンを永遠に無償使えます。

※1回最低限500個ライセンス購入必要、1個1000円です。 2)日昇カメラを購入する場合にはカメラと同じの数でライセンス発行できます。ライセンス料金はカメラ購入数により割引も可能です。

●製品使用開始後、メンテンナスの安心サービス必要の場合、⑬メンテナンス契約締結も行う

過去の実績に基づき、導入後、同じのバージョンで基本的にメンテナンス不要となります。

24時間のP2Pサービスが多いですので、安心のため、安い年間メンテナンス契約も作成可能です。

詳しくは別途ご相談必要です。

- 2024.02.27

- 18:51

- コメント (0)

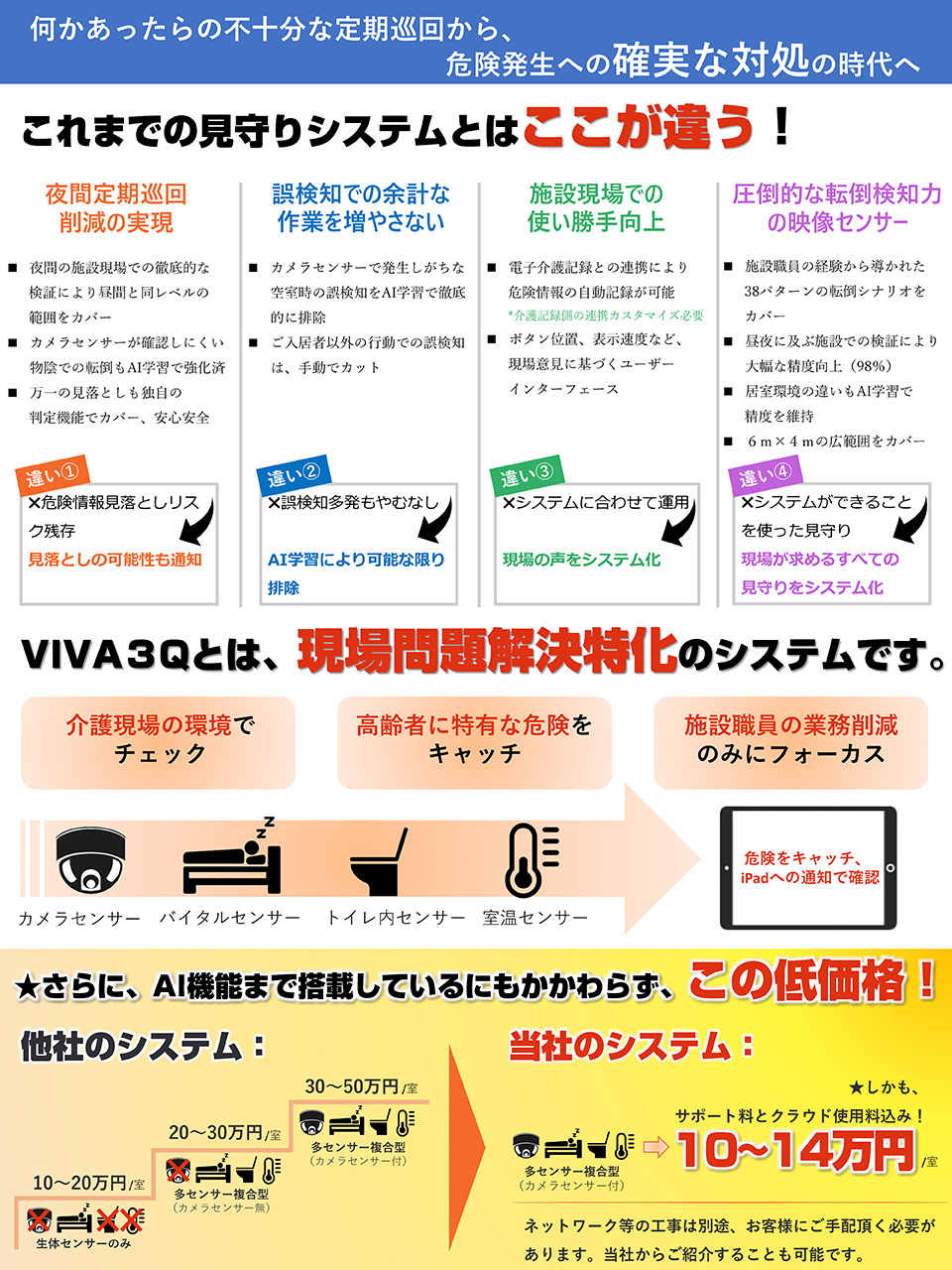

介護分野に向けAIソリューション

※VIVA3Qシステム購入について、弊社戦略パートナー(株式会社オリエントテクノロジー)のホームページから問い合わせをください。こちら

●AI自動巡回機能によりスタッフの夜間定期巡回削減

●AI学習機能により高齢者、部屋が違っても誤検知を抑えてスタッフの余計作業を増やさない

●介護記録システムと連携により、スタッフの手作業を減らす

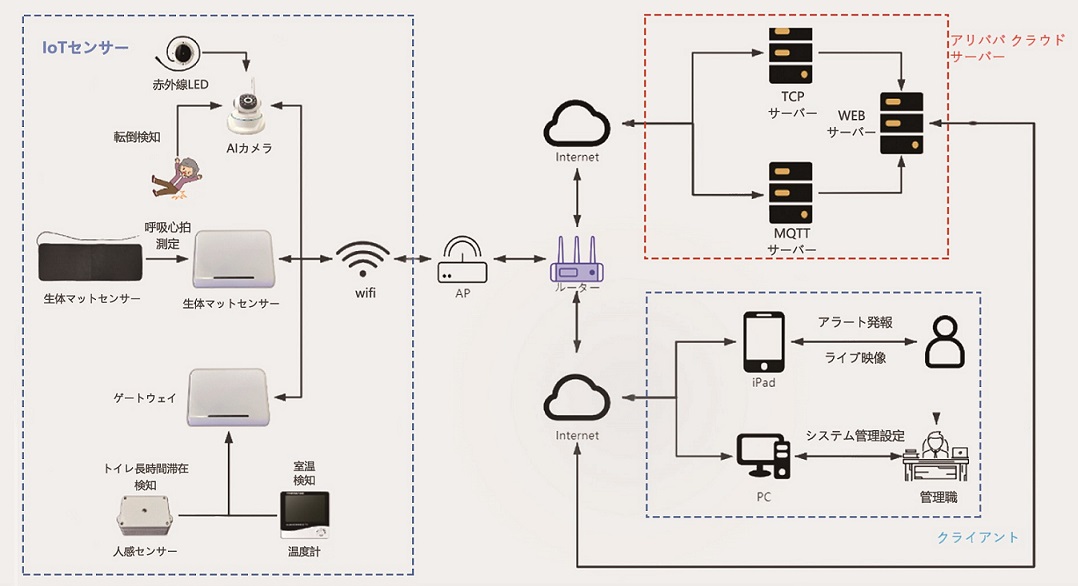

GW、生体センサーコントローラ、カメラ本体からこれらのデータを基づき、高齢者の状態を判定し、その判定結果はシステムクラウドサーバーに送られ、

クラウドサーバーから総合的に判断を行い、判断の結果はクライアント側(iPad、PC)にお知らせ、スタッフあるいは管理者からそのお知らせを受け、アクションを取ります。

●生体センサーは時系列のディープラーニングCNNにより呼吸・心拍を算出

●カメラは本体でビデオを収集し、AIエンジとのやり取りでAIエンジ側から認識結果を返す。(AI本体でもAIアルゴリズム動作可能)

●WebRTCのSDKをカメラ本体に動作させてP2Pライブビデオ再生、ローカル録画、ビデオダウンロード機能実現

●PC WEB画面からライブビデオも見れ、録画時間検索により、早く特定できている一方、AI持続訓練データとしても使用可能(施設側から承諾を得る必要)

●弊社長年のIOTセンサー、IOT通信技術も活用

●ローカル録画、ローカルAI動作、さらにぼかし機能を付けてプライバシーとセキュリティー心配ない

●拡張性を確保しているクラウドサーバー設計も行い、今後、クラウドサーバーからAI大規模モデルを使って、より知能できな機能を提供可能

他に画像認識で活用分野でもよいです、建築現場安全見守り、店舗内集客、ビル管理システム、オフィス社員行動分析、物流倉庫荷物集計、駐車場車両ナンバー認識等

●完成品カメラ提供、OEMでお客様のロゴでも載せる

●AIカメラ本体でAIアルゴリズム動作可能となり、さらに強い計算力のAIエンジ機器も提供

●webRTCミドルウエア提供、クライアント側とサーバーが両方があり、P2Pライブビデオ、録画、ダウンロード機能を素早く実現

●カスタマイズ開発環境を提供、勿論、AI動作可能の環境もある

●AIアルゴリズム受託開発も受け入れ、基本的に5-6週間完了

●クライアント側、サーバー側のアプリも受託開発可能(別途相談)

上記ソリューションポイントにより、AI開発能力ない企業としても自社の業務により、素早くAIシステム導入可能です。弊社は、プロフェッショナルなカメラモジュールとAI画像処理ソリューションの専門プロバイダとなり、HWと合わせてAI活用を安く早く実現する

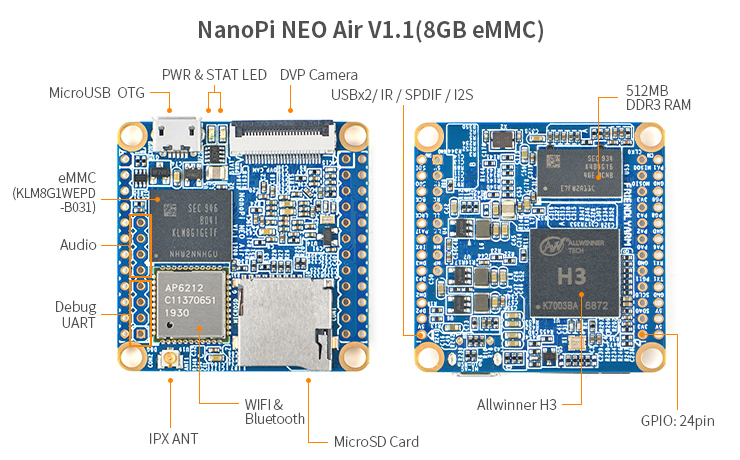

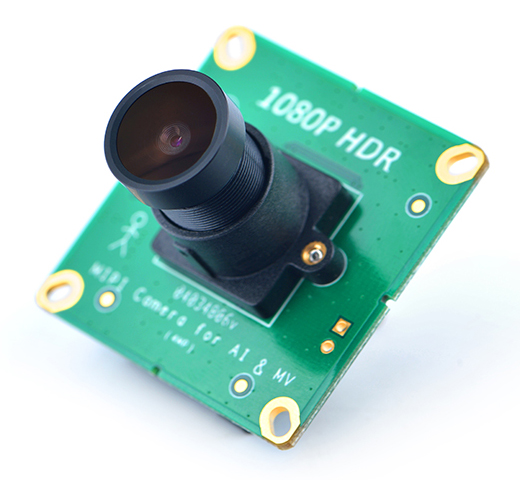

●AIカメラ本体と同じCPU評価基板(詳しくは下記リンクをクリック)

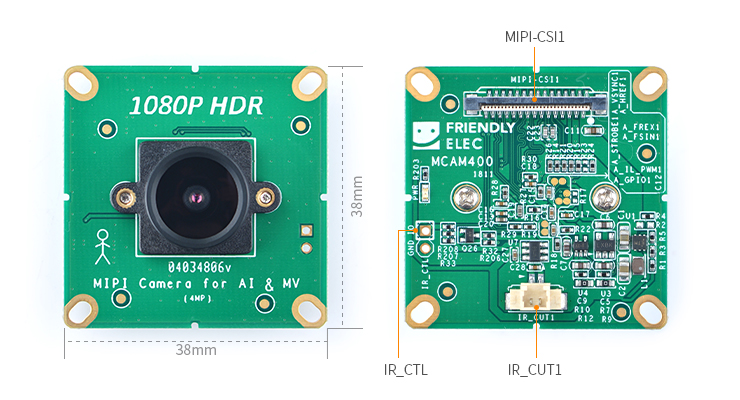

●AIカメラ本体と同じのカメラモジュール(詳しくは下記リンクをクリック)

●AIカメラ完成品の様子(OEM可能)

●AIエンジデバイス(詳しくは下記リンクをクリック)

●WebRTCミドルウエア導入(AIカメラ本体、iPad、PC Web側、クラウドサーバー側はすべてある)

※ライセンス料金についてはホームページから問い合わせをください。

●AIアルゴリズムカスタマイズ開発可能

一般的に、受注してから5-6週間完了見込みです。

- 2024.02.22

- 16:59

- コメント (0)

AIソリューション事例一覧